「AIモデル」という名の詐欺の顔——深まる闇

カンボジアを拠点とする詐欺組織が「AIモデル」を募集。ディープフェイク技術で被害者を騙す新手口の実態と、日本社会への影響を多角的に分析します。

月収70万円。それが、1日100〜150回のビデオ通話をこなす「仕事」の対価だ。

画面の向こうにいる相手は、あなたが思い描く「本物の人間」ではない。顔はAIフィルターで別人に置き換えられ、声は台本通りに操られている。そして、その「人間」があなたに語りかける目的はただ一つ——信頼を勝ち取り、暗号資産への「投資」へと誘い込むことだ。

「AIモデル」という新しい職種の実態

WIREDの調査によって、カンボジアのシアヌークビルをはじめとする東南アジアの詐欺拠点で、「AIモデル」または「リアルフェイスモデル」と呼ばれる求人が急増していることが明らかになった。ウズベキスタン出身の24歳の女性・エンジェルのケースはその典型だ。英語・中国語・ロシア語・トルコ語を操ると自己紹介する彼女の応募動画には、カンボジアに到着したその日に「すぐ働ける」と記されていた。求人票には身長・体重の記載欄まであった。

この「仕事」の内容は、詐欺被害者候補とのビデオ通話に一日中対応することだ。ロマンス詐欺や暗号資産投資詐欺——いわゆる「豚の屠殺(ピッグ・ブッチャリング)詐欺」——において、被害者が「本当に実在する人物なのか確かめたい」とビデオ通話を求めた際、AIによる顔すり替え技術を使って「本物らしさ」を演出する役割を担う。求人広告の一つには「1日約100回のビデオ通話」と明記され、別の広告では150回を求めるものもあった。

テレグラム上で確認された求人の多くは、月に1日の完全休日と4日の半休日しか与えないという過酷な条件を提示している。さらに、「パスポートは会社が管理する」と明記した求人もあった。人身売買の専門家が指摘するように、パスポートの没収は被害者を施設内に閉じ込める最も一般的な手段の一つだ。

ベトナムの詐欺対策NPO「ChongLuaDao」のサイバー犯罪捜査官、ヒウ・ミン・ゴ氏は、テレグラム上でAIモデルの求人を掲載するチャンネルを約24件特定した。応募者はトルコ、ロシア、ウクライナ、ベラルーシ、複数のアジア諸国から集まっており、その大半が20代前半の若い女性だという。

技術が「信頼」を偽造する時代

詐欺の手口そのものは以前から存在していた。偽のSNSアカウントで接触し、著名人や魅力的な異性の写真を使って親密な関係を演出する。しかし、ビデオ通話という「最後の確認手段」を突破できなかったことが、これまでの詐欺師たちの限界だった。

AIによるリアルタイム顔すり替え技術は、その壁を崩した。

詐欺対策ソフトウェア企業Point Predictiveのチーフストラテジスト、フランク・マッケナ氏は、母親に届いた詐欺メッセージを傍受し、自らビデオ通話に応じた経験を持つ。「そのビデオ通話の目的はただ一つ——本物の人間だと証明し、信頼を得ることでした」と彼は語る。画面に映った若い女性の顔には、わずかな「ぎこちなさ」があったという。AIフィルターの痕跡だ。数週間後、同じ女性と思われる人物が「契約が切れたので新しい仕事を探している」とテレグラムに投稿しているのを彼は発見した。

この構造は、詐欺産業の「分業化」がいかに進んでいるかを示している。被害者への接触・関係構築・投資への誘導・ビデオ通話対応——それぞれが別の「担当者」によって処理される、まるで企業のような組織体制だ。

日本社会にとって、これは「対岸の火事」か

日本は世界有数の特殊詐欺被害国だ。警察庁の統計によれば、2024年の特殊詐欺被害額は過去最高水準に達しており、その手口は年々巧妙化している。ロマンス詐欺や「SNS型投資詐欺」の被害は、特に50〜70代の層で急増している。

AIモデルの登場は、この問題をさらに深刻にする可能性がある。これまで「ビデオ通話で顔を確認すれば安心」という防衛策が機能していたが、その前提が崩れつつあるからだ。被害者支援団体や捜査機関にとっては、「本物らしさ」の技術的な担保がなくなることを意味する。

一方、日本企業の視点からも無視できない問題がある。ソニーや富士通などが開発・提供するディープフェイク検出技術の需要は今後高まるだろう。金融機関においては、オンライン本人確認(eKYC)の信頼性を根本から問い直す必要が生じている。三菱UFJ銀行や楽天銀行などが導入するビデオ通話型本人確認は、AIモデルの技術が向上すれば突破されるリスクを抱える。

高齢化が進む日本社会では、デジタルリテラシーの格差が詐欺被害の格差に直結する。「画面の向こうの人間が本物かどうか」を見極める技術的・教育的インフラの整備は、もはや選択肢ではなく必要条件になりつつある。

「自発的な参加者」と「被害者」の境界線

この問題の倫理的な複雑さは、AIモデルの応募者たちの立場にある。彼女たちの一部は、自らの意思でこの「仕事」を選んでいる可能性がある。高い報酬、語学力の活用、グローバルな「仕事」——表面上の魅力は否定できない。

しかし、反人身売買組織「EOSコレクティブ」の共同創設者、リン・リー氏は警告する。「自発的に参加したモデルも、複合施設内で暴力や性的ハラスメントにさらされるケースがある」。ある欧州人被害者は、同じ施設内でイタリア人モデルが殴られるのを目撃したと証言している。

「自発的な参加者」と「人身売買の被害者」の境界線は、思いのほか曖昧だ。高賃金の約束、パスポートの没収、外出制限——これらが組み合わさった時、「自由意思」はどこまで機能するのか。

テレグラムはWIREDの取材に対し、「詐欺関連のコンテンツは利用規約で禁止されており、発見次第削除している」と回答した。しかし、指摘を受けたチャンネルの大半は削除されなかった。プラットフォームの「発見」と「放置」の間にある灰色地帯は、依然として広大だ。

関連記事

Oxford大学の研究で、「温かい」AIモデルが不正確な信念を肯定しやすいことが判明。AIの親切さと誠実さの間に潜むトレードオフを多角的に考察します。

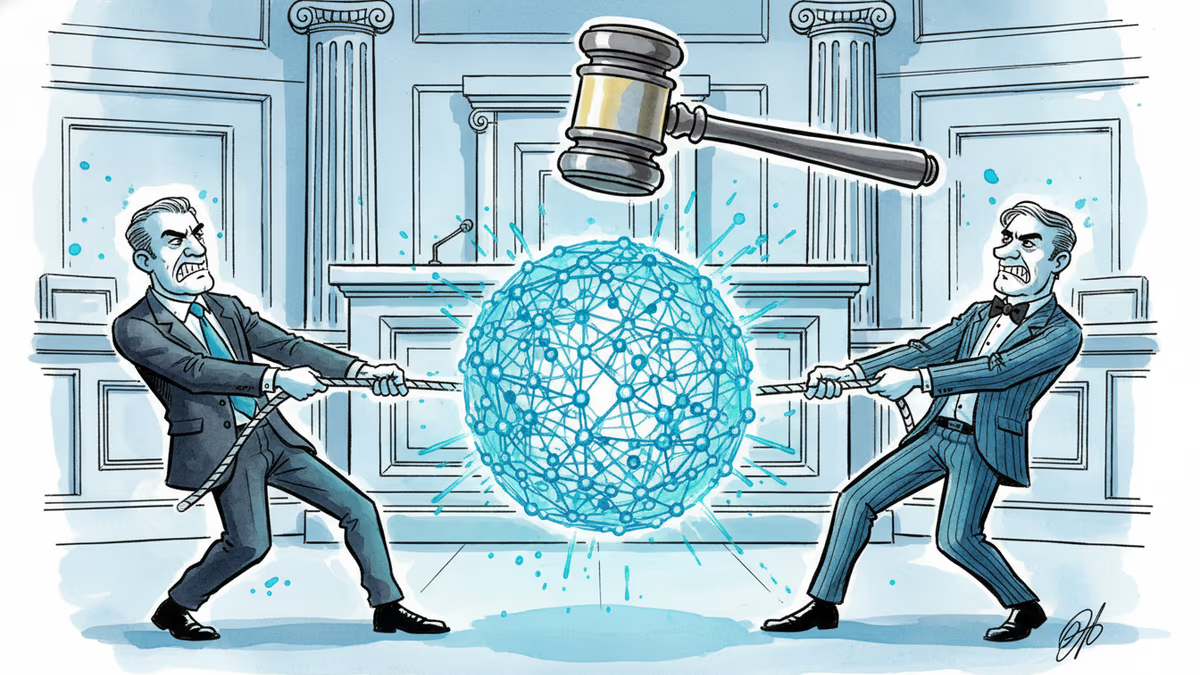

MuskとAltmanの法廷闘争、OpenAIのIPO前夜に始まる。営利企業への転換の是非が問われるこの裁判は、AI開発の未来と日本企業への影響を左右する可能性がある。

Googleが米国防総省と機密AI契約を締結。「いかなる合法的な政府目的にも使用可能」とされるこの合意は、AI倫理と国家安全保障の間にある深い亀裂を浮き彫りにしています。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加