AIの良心は、政府の命令に従わなければならないのか

トランプ政権がAIスタートアップAnthropicに制裁を科し、政府調達からの排除を検討。AIの倫理原則と国家権力の衝突が、テック業界全体に波紋を広げています。

「ミサイル発射に人間の監督は不要だ」——もしAIにそう命じられたとしたら、あなたはどう答えますか。Anthropicはその問いに「ノー」と言い、今、政府から締め出されようとしています。

何が起きているのか:倫理の拒否が招いた制裁

2026年3月11日現在、AIスタートアップAnthropicはトランプ政権との法廷闘争の渦中にあります。事の発端は、国防総省がAnthropicに対し、自社のAI技術「Claude」を「軍が合法と判断するあらゆる目的」に使用することへの同意を求めたことでした。Anthropicはこれを拒否しました。理由は明確です——広範な市民監視や、人間の監督なしでのミサイル発射などに技術が転用される可能性を懸念したからです。

この拒否に対し、国防総省はAnthropicを「サプライチェーン・リスク」として指定。事実上、同社を連邦政府との取引から排除しました。さらにトランプ大統領は現在、政府全体でAnthropicのツール使用を正式に禁止する大統領令の最終調整を進めているとされています。

Anthropicは月曜日(3月9日)、この指定は違憲であるとして連邦政府に対し2件の訴訟を提起。翌火曜日には最初の法廷審問が行われました。同社の弁護士は「被告の行為は回復不能な損害を引き起こしており、その損害は日々拡大している」と訴えました。現在、既存顧客や見込み客が次々と契約を見直したり離脱したりしており、数十億ドル規模の収益が危機に瀕しているといいます。

連邦地裁判事リタ・リン氏は予備審問の日程を3月24日(サンフランシスコ)に設定しましたが、Anthropicはさらに早期の審問を求めていました。司法省側の弁護士は「追加措置を取らないとは約束できない」と明言しており、政府の強硬姿勢は変わっていません。

なぜ今重要なのか:これは「Anthropicだけの問題」ではない

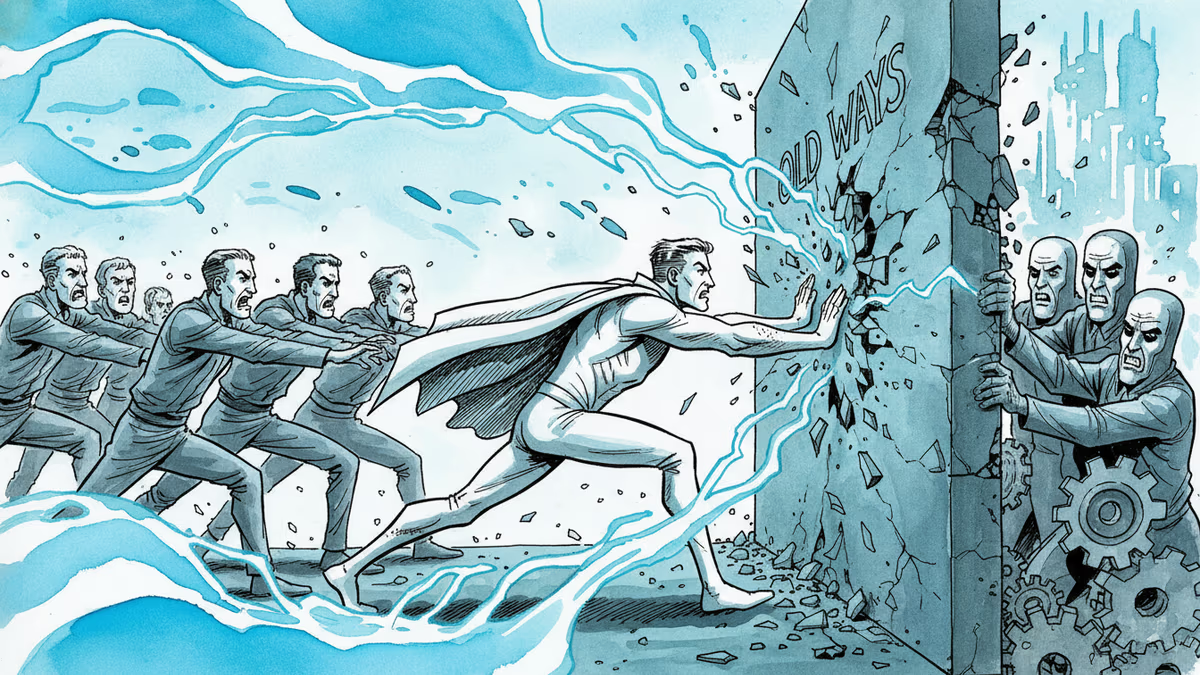

この訴訟の核心にあるのは、一企業の生き残り問題ではありません。AIの倫理原則は、政府の命令より優先されるのかという、テック産業全体が直面する問いです。

イェール大学ロースクールのハロルド・コー教授(元オバマ政権高官)は「これは単独の事例ではなく、懲罰的な大統領権力行使の連鎖の一部だ」と指摘します。大学、メディア企業、法律事務所に続き、今度はAI企業が標的になったというわけです。実際、Anthropicの代理人を務める法律事務所WilmerHale自体も、トランプ政権から制裁を受けている企業の一つです。

法的な観点からは、国防総省がAnthropicに適用した条項は本来、国家の敵による妨害行為から国を守るために設計されたものです。ジョージタウン大学のデビッド・スーパー教授は「ペンタゴンのあらゆる要求に同意しないことを『妨害行為』と同一視するのは、英語の乱用も甚だしい」と批判します。

一方で、OpenAIやGoogleはこの混乱に乗じて、Anthropicが失った国防総省との契約を獲得しようと動いています。倫理を盾にとった企業が市場を失い、そうでない企業が利益を得るとすれば、業界全体に何を示唆するでしょうか。

日本企業への示唆:「他人事」ではない理由

日本のビジネス環境において、この事態はいくつかの重要な問いを提起します。

ソニー、富士通、NTTなど、米国のAIツールを業務に組み込んでいる日本企業は少なくありません。Claudeを活用したサービスや製品を開発しているパートナー企業も存在します。もし米国政府によるAnthropicの排除が長期化すれば、こうした企業はサービスの継続性リスクに直面する可能性があります。

より広い視点では、この事態は「AIガバナンスの主導権は誰が持つべきか」という問いに直結します。日本政府は2023年のG7広島サミット以来、AI安全性に関する国際的な議論をリードしてきました。しかし米国でこのような形で「政府がAI企業の倫理基準を強制できる」という前例が作られるとすれば、国際的なAIガバナンスの枠組みにも影響を与えかねません。

労働力不足が深刻な日本では、AIの活用は社会的な必要性でもあります。だからこそ、AIツールの「信頼性」や「継続性」に対する不安は、単なるビジネスリスクを超えた意味を持ちます。

関連記事

Googleが米国防総省と機密AI契約を締結。「いかなる合法的な政府目的にも使用可能」とされるこの合意は、AI倫理と国家安全保障の間にある深い亀裂を浮き彫りにしています。

イーロン・マスクがOpenAIとサム・オルトマンCEOを訴えた裁判が開幕。1340億ドルの損害賠償請求と、AI業界の覇権争いの行方を徹底解説します。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

ホワイトハウス記者夕食会でトランプ大統領への暗殺未遂事件が発生。容疑者はカルテック出身の機械工学者。事件の背景と、民主主義社会が直面する深層的な問いを読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加