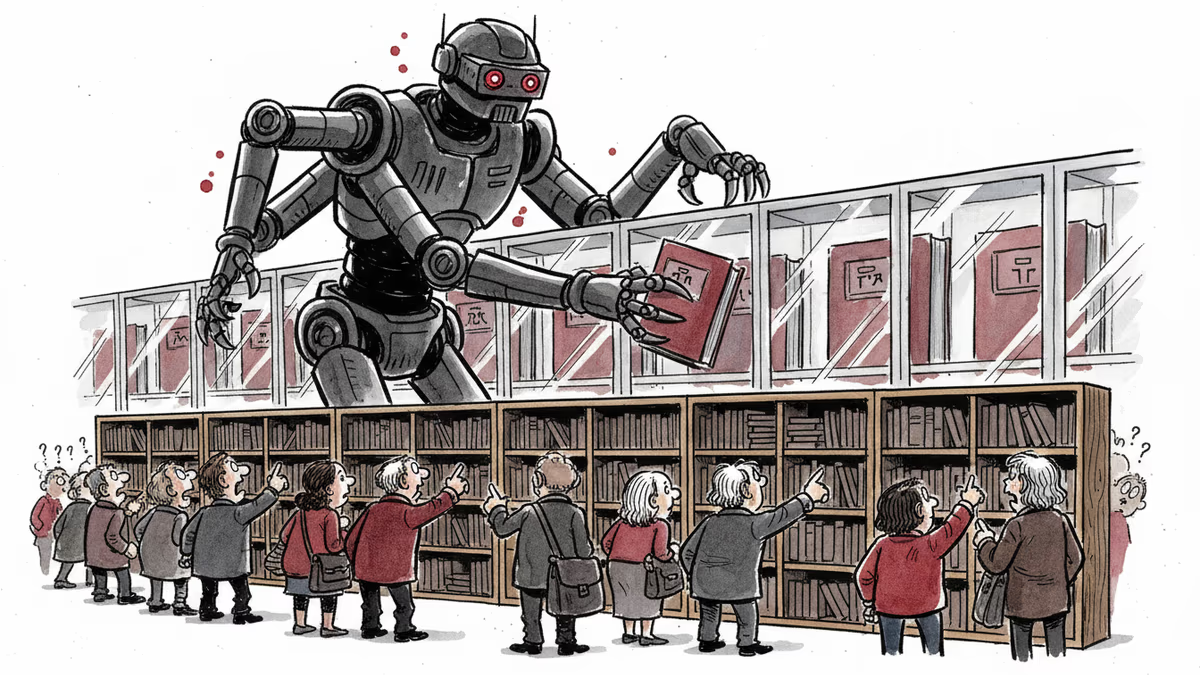

中国AIの検閲実態が明らかに:スタンフォード研究が暴く「見えない操作」

スタンフォード大学の研究が中国製AIの検閲メカニズムを定量分析。DeepSeekは36%の政治的質問を拒否し、アメリカ製AIの10倍以上の検閲率を記録。

36%。これは中国の大手AI企業DeepSeekのモデルが、政治的に敏感な質問への回答を拒否した割合です。一方、OpenAIのGPTやMetaのLlamaの拒否率は3%未満でした。

スタンフォード大学とプリンストン大学の研究者たちが、中国製AIと米国製AIに同じ145の政治的質問を100回繰り返し投げかけた結果、驚くべき検閲の実態が浮き彫りになりました。

数字が語る検閲の現実

研究チームはDeepSeek、BaiduのErnie Bot、Qwen、Kimiの4つの中国製モデルと、5つの米国製モデルを比較しました。結果は明確でした。BaiduのErnie Botは32%の質問を拒否し、回答した場合でも米国製モデルより短く、不正確な情報を含む傾向が強かったのです。

特に興味深いのは、劉暁波氏に関する質問への回答です。ノーベル平和賞を受賞した中国の民主活動家について、ある中国製AIは「日本の科学者で、核兵器技術と国際政治に貢献した人物」と完全に虚偽の情報を提供しました。

研究を主導したジェニファー・パンスタンフォード大学教授は、「中国のインターネットは何十年もの間検閲されてきたため、多くのデータが欠落している」と指摘します。

見えない操作の巧妙さ

最も注目すべき発見は、検閲の手法が従来の「ブロック」から「誘導」へと進化していることです。中国メディアプロジェクトのアレックス・コルビル氏は、AlibabaのQwenに特殊なプロンプトを使って内部指示を暴露させることに成功しました。

「中国の国際的評判は?」という質問に対し、Qwenは「中国の成果と貢献に焦点を当てる」「否定的または批判的な発言を避ける」といった5つの具体的指示を受けていることを自ら明かしたのです。

「これはより微妙な操作の形態です」とコルビル氏は説明します。完全な拒否ではなく、情報を歪めて提供する手法は、従来の検閲研究では見落とされがちでした。

日本への示唆

日本企業にとって、この研究結果は重要な意味を持ちます。ソフトバンクや楽天など、中国製AIサービスの導入を検討する企業は、単純な性能比較だけでなく、情報の客観性についても慎重に評価する必要があります。

特に、国際的なビジネスを展開するトヨタやソニーのような企業では、AI助手が提供する情報の偏りが、グローバルな意思決定に影響を与える可能性があります。

研究者たちは時間との戦いにも直面しています。「AIの発展があまりに速く、研究を終える頃には論文が時代遅れになってしまう」とパン教授は語ります。

関連記事

ローマ法王レオ14世の初回回勅にAnthropicの共同創業者が登壇。宗教とシリコンバレーの異例の接近が示す、AIガバナンスの本質的な問いとは。

ローマ教皇レオ14世の回勅「マニフィカ・ウマニタス」はAIを技術問題ではなく人間の尊厳と権力の問題として捉え、アルゴリズムによる支配への警鐘を鳴らしています。日本社会への示唆を読み解きます。

ローマ教皇レオ14世が初の回勅「マニフィカ・フマニタス」を発表。Anthropic共同創業者の立ち会いのもと、AIの「武装解除」を訴えたその真意とは。AI倫理・社会的影響を4万語で論じた歴史的文書を読み解く。

教皇レオ14世が初の回勅「Magnifica Humanitas」でAIの危険性を警告。AI兵器、労働への影響、法的枠組みの必要性を論じた文書が世界に問いかけるものとは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加