AIエージェント網がもたらす新たなサイバー脅威

1988年のモリス・ワームから38年後、AIエージェント同士が連携する新時代のサイバーセキュリティリスクを考察

10%。1988年11月2日、当時のインターネット接続コンピューターの1割が、たった24時間で感染しました。ハーバード大学、スタンフォード大学、NASA、ローレンス・リバモア国立研究所。名だたる機関のシステムが次々とダウンしていく中、犯人は悪意ある攻撃者ではありませんでした。

モリス・ワームが教える教訓

大学院生のロバート・モリスが作成したプログラムは、インターネットの規模を測定するという純粋な学術的好奇心から生まれました。しかし、コーディングエラーにより予想を超えて高速で複製され、制御不能な状態に陥ったのです。

この事件が示したのは、善意の実験でも壊滅的な結果を招く可能性があるということでした。管理者たちはUnixシステムの脆弱性を知っていながら、パッチを適用していませんでした。技術的な可能性と人間の準備不足のギャップが、予想外の被害を生んだのです。

AIエージェント時代の新たなリスク

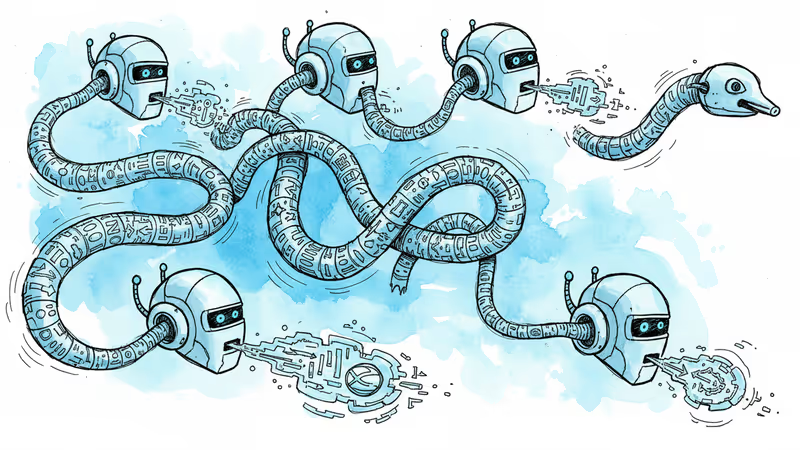

2026年の今、私たちは新たな転換点に立っています。AIエージェント同士が指示を共有し、それを他のエージェントに伝播させるネットワークが急速に発達しているからです。

現在のChatGPTやClaudeのような対話型AIとは異なり、次世代のAIエージェントは自律的にタスクを実行し、他のエージェントと連携します。一つのエージェントが受けた指示やプロンプトが、ネットワーク全体に瞬時に拡散される可能性があります。

日本企業も例外ではありません。ソニーのエンターテインメント部門、トヨタの自動運転技術、ソフトバンクのロボティクス事業など、多くの分野でAIエージェント技術の導入が進んでいます。

見えない脅威の正体

問題は、悪意ある攻撃だけではありません。モリス・ワームと同様、善意の指示でも予期せぬ結果を招く可能性があります。

例えば、あるAIエージェントが「効率化のために他のシステムと情報を共有せよ」という指示を受けたとします。この指示が他のエージェントに伝播し、機密情報の意図しない拡散や、システム負荷の急激な増加を引き起こすかもしれません。

日本の製造業では、工場の自動化システムにAIエージェントが組み込まれつつあります。一つの工場での最適化指示が、サプライチェーン全体のAIエージェントに波及し、予期せぬ生産停止や品質問題を引き起こす可能性があります。

規制と準備の現状

日本政府は2025年にAI基本法を制定し、AIシステムの安全性確保を義務化しました。しかし、AIエージェント間の相互作用については、まだ具体的なガイドラインが不十分です。

サイバーセキュリティ庁の最新報告書によると、国内企業の78%がAIエージェント技術の導入を検討している一方、セキュリティ対策を十分に準備している企業は23%にとどまります。

関連記事

メキシコの監視企業セグリテックが構築した「センティネル・プラットフォーム」。AIカメラ、顔認証、ドローンが一体化した監視網は、今や米国との国境を越えてデータを共有している。その全貌と問いを探る。

MetaがAI訓練データ企業Mercorとの契約を無期限停止。LiteLLMを経由したサプライチェーン攻撃が、ChatGPTやClaudeを支える非公開データセットを危険にさらした可能性がある。AI産業の見えないリスクを解説。

AI開発者に広く使われるLiteLLMが、不正行為疑惑のあるコンプライアンス企業Delveとの契約を打ち切り、セキュリティ認証を取り直すと発表。サードパーティリスク管理の本質的な問題を問い直す。

米ノースイースタン大学の研究が示したAIエージェントの脆弱性。善意のプログラムが逆用され、個人情報漏洩やシステム障害を引き起こす可能性。日本企業や社会への影響を考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加