AIが書いたコードは「クリーンルーム」か?

オープンソースライブラリchardetのAI支援リライトが、著作権・ライセンス・倫理の観点から新たな問いを提起。ソフトウェア開発の「クリーンルーム」原則はAI時代に通用するのか。

AIに「古いコードを参考に、新しく書き直して」と頼んだとき、それは本当に「新しいコード」なのでしょうか。

chardetの「リライト」が問いかけるもの

2026年3月初旬、Pythonの世界でひとつの小さな出来事が、大きな議論の火種になりました。文字エンコーディングを自動検出するオープンソースライブラリ chardet のバージョン7.0がリリースされたのです。

chardet はもともと2006年、開発者の Mark Pilgrim が作成し、LGPL(劣後一般公衆利用許諾契約) というライセンスのもとで公開されていました。LGPLは、ライブラリを利用したソフトウェアを配布する際に一定の条件を課す、比較的厳格なライセンスです。2012年に Dan Blanchard がメンテナンスを引き継ぎ、長年にわたって多くの開発者に使われてきました。

ところが今回のバージョン7.0で、Blanchard は大きな決断をしました。Claude Code(Anthropic 社のAIコーディングツール)の助けを借りて、ライブラリ全体を「ゼロから書き直した」と発表したのです。そして新しいコードには、LGPLより制限の緩い MITライセンス を適用しました。「以前より大幅に高速で正確になった」と説明されています。

この発表は、技術的な改善の話にとどまりませんでした。「AIを使って既存のコードをリライトし、ライセンスを変更する」という行為が、法的・倫理的に許されるのかという問いを、コミュニティに投げかけることになったのです。

「クリーンルーム」とは何か、そしてAIはそれを壊すのか

ソフトウェア開発の世界には、「クリーンルーム・リバースエンジニアリング」という古典的な手法があります。あるプログラムの機能を再現したいとき、元のコードを直接コピーするのではなく、「仕様を理解するチーム」と「実際にコードを書くチーム」を完全に分離することで、著作権侵害を回避する方法です。IBMのBIOSを合法的に複製した1980年代の Compaq の事例が有名で、PC産業の発展を支えた重要な法的概念です。

この手法が成立する前提は、「新しく書いたコードが元のコードから独立している」という証明可能な事実です。しかしAIコーディングツールは、その前提を揺るがします。

AIモデルは膨大なコードデータで学習しています。chardet のような有名なオープンソースライブラリも、当然その学習データに含まれている可能性が高い。AIが「ゼロから書き直した」コードは、本当に元のコードから独立しているのでしょうか。それとも、学習データを通じて元のコードの「記憶」を持ち込んでいるのでしょうか。現時点では、誰もその答えを確かめる手段を持っていません。

日本の開発現場への影響

日本のソフトウェア産業にとって、この問題は決して他人事ではありません。

ソニー、トヨタ、富士通 など、日本の大手企業は製品やシステムの開発に膨大な量のオープンソースソフトウェアを使用しています。LGPLライセンスのライブラリを組み込んだ製品を販売している企業も少なくありません。もし「AIリライト=クリーンルーム」という解釈が法的に認められれば、ライセンス管理の実務が根本から変わる可能性があります。逆に認められなければ、AIツールを使ったコード刷新プロジェクトに法的リスクが生じます。

また、日本では 2025年のAI著作権ガイドライン の整備が進んでいますが、「AIが生成したコードの著作権帰属」という問題はまだ明確な答えが出ていません。今回の chardet 問題は、そのグレーゾーンを正面から突いています。

労働力不足が深刻な日本では、AIコーディングツールへの期待が特に高い。しかしその活用に法的不確実性が伴うとすれば、企業の導入判断に慎重さが求められることになります。

オープンソースコミュニティの反応

開発者コミュニティの反応は複雑です。「技術的に優れたコードが生まれたなら問題ない」という実用主義的な意見がある一方、「LGPLという元の作者の意思を、AIを使って迂回するのは倫理的に問題だ」という声も上がっています。

Mark Pilgrim が2006年にLGPLを選んだのには理由があったはずです。LGPLは「ライブラリを使った商用ソフトウェアを作ることは許可するが、ライブラリ自体の改変版を公開する場合は同じライセンスを維持しなければならない」という思想を持っています。その意思が、AIリライトとライセンス変更によって実質的に無効化されたとすれば、オープンソースの「社会契約」に対する信頼が揺らぎかねません。

一方で、Blanchard の立場も理解できます。長年メンテナンスしてきたライブラリをより使いやすい形で提供したい、という動機は正当です。AIツールを使ったとしても、人間の判断と責任のもとで行われたリライトであれば、それは「ツールを使った創作」ではないか、という議論もあります。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

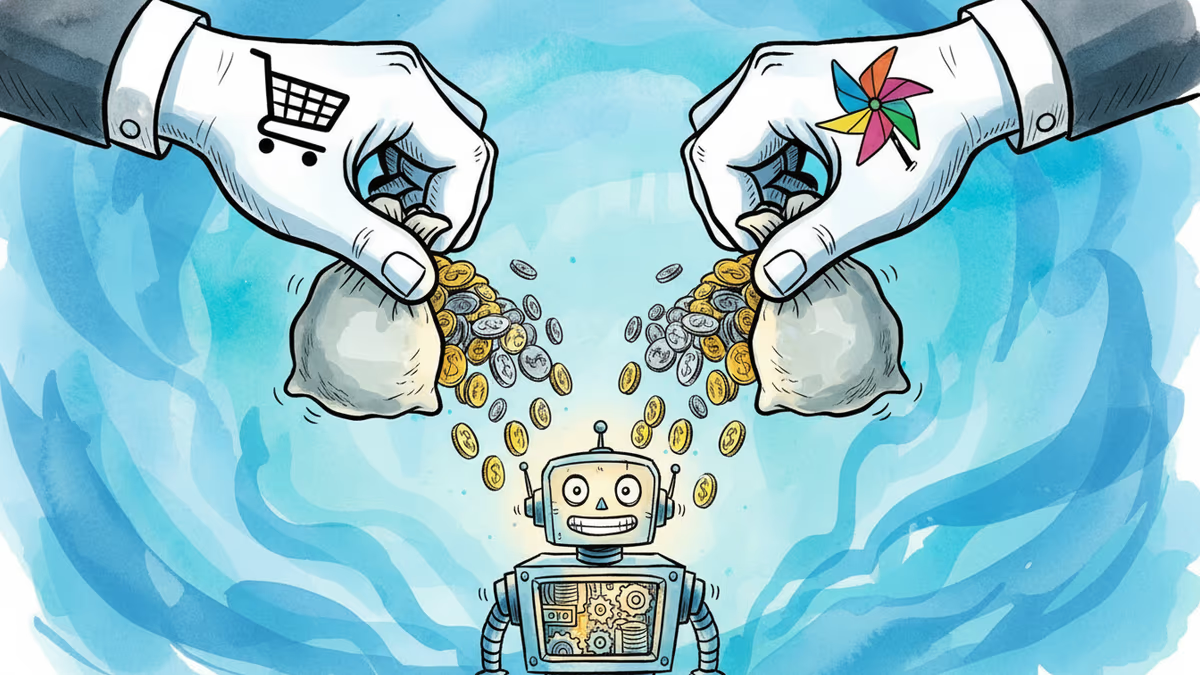

GoogleがAnthropicに最大4兆円、AmazonはすでにAnthropicに5,000億円超を投資。両社が競合しながらも同じAIスタートアップに巨額を注ぐ構図が示す、AI覇権争いの新局面とは。

カナダのCohere社とドイツのAleph Alpha社が合併し、企業価値200億ドルの「大西洋横断AIパワーハウス」が誕生。米中テック大手に依存しない選択肢を求める企業・政府にとって何を意味するか。

GoogleがAnthropicに最大400億ドル(約4兆円)を投資。競合でありながら最大の支援者という複雑な関係が、AI産業の構造的変化を映し出している。日本企業への影響も考察。

MetaがAWSのGravitonチップで大規模AI処理を行う契約を締結。GPU一強時代に変化の兆し?CPUが再び主役になる可能性と、日本企業への示唆を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加