米軍、機密データでAIを訓練へ――その先にある問い

米国防総省が機密データを用いたAIモデルの訓練計画を検討中。OpenAIやxAIが関与し、軍事AIの精度向上を目指す一方、情報漏洩リスクや倫理的課題が浮上しています。

2026年初頭、ペンタゴンの一室で、ある実験が静かに始まろうとしています。衛星画像、戦場評価レポート、ヒューマンインテリジェンスの記録――これまで人間の目だけが許されていたデータを、AIモデルに「読ませる」計画です。

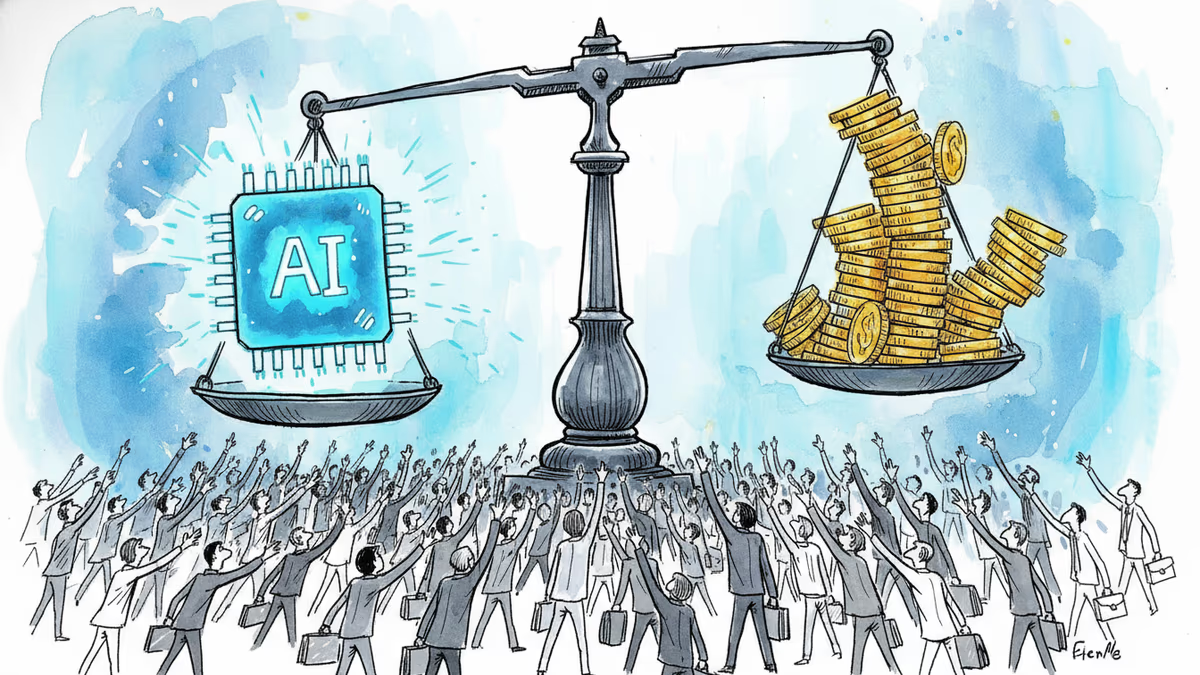

米国防総省が、OpenAIやイーロン・マスク率いるxAIなどの生成AIメーカーと協力し、機密データを使ってAIモデルを訓練するための安全な環境の構築を検討していることが、MIT Technology Reviewの取材で明らかになりました。これは単なるAI活用の拡大ではありません。AIが機密情報を「知識として内包する」という、これまでとは質的に異なる段階への移行を意味します。

何が起きているのか

これまでも、アンソロピックのClaudeのような商用AIモデルは、機密環境内での質問応答に使われてきました。イランの標的分析など、実際の軍事任務への適用事例も報告されています。しかし今回の計画は、その一歩先を行くものです。

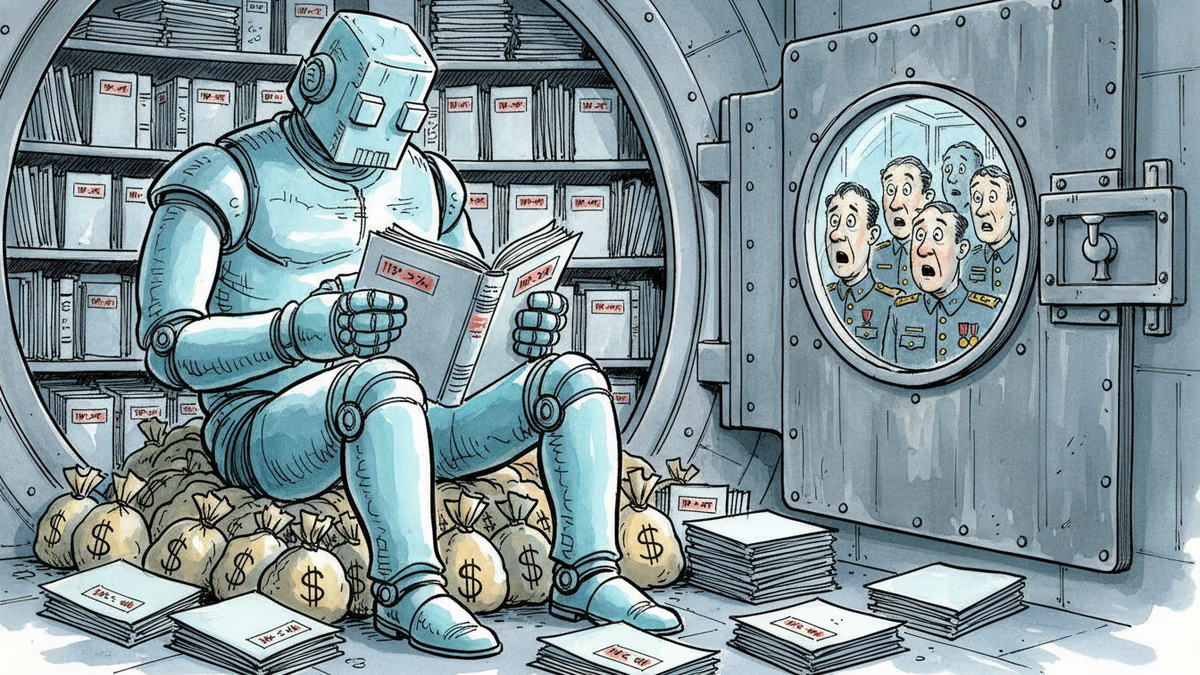

AIモデルが機密データを「参照する」のではなく、機密データから「学習する」――この違いは技術的には微妙に見えますが、セキュリティの観点からは根本的に異なります。訓練されたモデルには、機密情報がパラメータとして埋め込まれます。つまり、情報はもはや「保管庫の中」ではなく、「モデルの記憶の中」に存在することになるのです。

計画によれば、訓練は政府の機密プロジェクトを受け入れる認定を受けたセキュアなデータセンターで行われます。データの所有権は国防総省が保持しますが、適切なセキュリティクリアランスを持つAI企業の担当者が、例外的なケースでデータにアクセスする可能性もあると、事情に詳しい米国防当局者は語っています。

国防長官ピート・ヘグセスが1月に発出したメモを受け、ペンタゴンはAIの軍事活用を加速させています。標的リストの作成や優先順位付け、契約書や報告書の起草など、すでに多くの場面で生成AIが使われています。今回の機密データ訓練計画は、その延長線上にある、より深い統合への試みです。

なぜ今、これが重要なのか

戦略国際問題研究所(CSIS)のワドワニAIセンターを率いるアーロク・メータ氏(元Google・OpenAI AIポリシー担当)は、機密データでの訓練が「質問に答える」こととは根本的に異なるリスクをはらむと指摘します。

最大の懸念は「情報の滲出」です。異なる機密区分を持つ複数の部署が同一のAIモデルを共有した場合、あるユーザーが意図せず、自分のアクセス権限を超えた情報を引き出してしまう可能性があります。「例えば、ある工作員の名前のような機密ヒューマンインテリジェンスにアクセスできるモデルが、その情報へのアクセス権を持たない国防総省の部署にその情報を漏らす可能性がある」とメータ氏は語ります。

一方で、外部の一般インターネットやAI企業へのデータ流出リスクは、適切な設計のもとでは比較的抑制可能だとも述べています。セキュリティ大手パランティアがすでに構築している機密AI環境が、その基盤となる可能性があります。

日本への視点:遠い話ではない

この動きは、日本にとって対岸の火事ではありません。

日本は現在、防衛省を中心にAI活用の検討を進めており、自衛隊の情報処理能力の強化が議論されています。米国との同盟関係のもと、インターオペラビリティ(相互運用性)の観点から、米軍のAI基盤と日本のシステムがどう連携するかという問いは、近い将来避けられないものになるでしょう。

さらに、日本企業の視点からも注目すべき点があります。NECや富士通、NTTといった国内IT大手は、防衛・公共分野でのAI活用を模索しています。米国が民間AI企業を機密環境に深く組み込むモデルを確立した場合、日本政府が国内企業に同様の役割を求めるシナリオも現実味を帯びてきます。その際、どのような資格審査や法的枠組みが必要になるのか、今から議論を始めるべき時期かもしれません。

加えて、AI訓練に使われる「機密データ」の中には、同盟国から提供された情報が含まれる可能性もあります。日本の情報機関が米国と共有した情報が、AIモデルの「知識」として組み込まれるとしたら――日本側はその事実をどこまで把握し、同意しているのでしょうか。

答えのない問いの重さ

技術的な実現可能性とは別に、この計画には哲学的な問いも内包されています。AIが機密情報を「学習」した場合、そのモデルを廃棄したとき、情報は本当に「消える」のでしょうか。人間のアナリストが退職後も記憶を持ち続けるように、AIモデルも何らかの形で情報を「保持」し続けるのではないか――そうした問いに、現時点では明確な答えはありません。

メータ氏も認めるように、どの軍事タスクが機密データ訓練を必要とするかを特定することは難しい。なぜなら「国防総省は、自国がその分野でどのような能力を持っているかを他国に知られたくない」からです。

関連記事

マスク対オルトマン裁判で公開された証拠品から、OpenAI創設期の内幕が明らかに。NvidiaのGPU提供、ミッション草案、内部の権力闘争まで、AI業界の原点を読み解く。

米国防総省がNvidia、Microsoft、AWSなどとAI導入契約を締結。130万人超の軍人がすでにAIを活用する中、軍事AIの倫理と安全保障のバランスが問われている。

イーロン・マスクがオープンAIとサム・アルトマンを提訴。非営利から営利への転換は「裏切り」か「進化」か。法廷で明かされる真実と、AI業界の未来を左右する問いを読み解きます。

AnthropicがIPO前の最終ラウンドで約50億ドルの調達を進行中。評価額は9000億ドルを超える可能性があり、OpenAIを抜いて世界最高値のAI企業となるかもしれない。日本企業への影響と、この数字が意味するものを読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加