軍はAIを「武器」にできるか――AnthropicとPentagonの法廷闘争

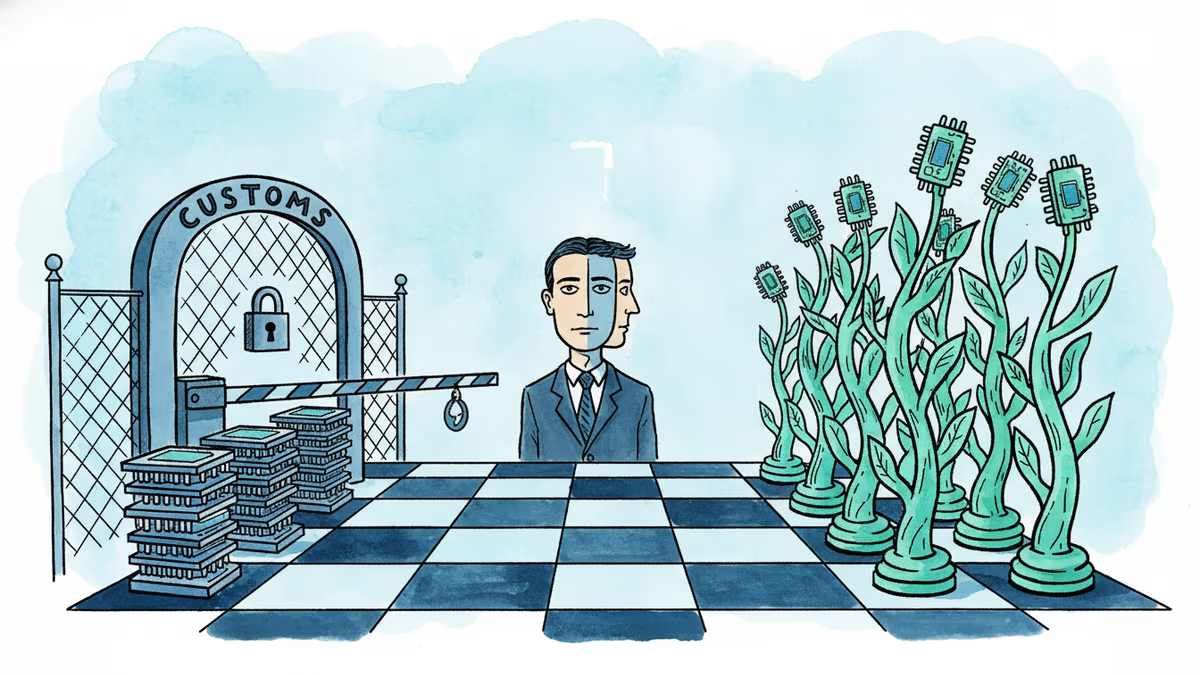

米国防総省がAI企業Anthropicを「サプライチェーンリスク」に指定。AIの軍事利用をめぐる法廷闘争が、シリコンバレーと政府の関係を根本から問い直している。

自社のAIが「どう使われるか」を気にした企業が、政府から「安全保障上の脅威」と名指しされる。これは近未来のSFではなく、2026年3月、米国の連邦法廷で実際に起きていることです。

何が起きているのか

Anthropicは、ChatGPTで知られるOpenAIの元幹部たちが設立したAI企業です。同社が開発するAIアシスタント「Claude」は、米国防総省(現在、トランプ政権下では「Department of War(DoW)」と改称)との契約のもと、軍事用途に活用されてきました。

問題の発端は、Anthropicが「自社のAIが軍事目的にどう使われるか」について制限を設けようとしたことでした。これに対し国防総省は、Anthropicをサプライチェーンリスクに指定。さらに国防長官のPete Hegseth氏はX(旧Twitter)に「直ちに、米軍と取引するすべての業者はAnthropicとの商業活動を禁止する」と投稿しました。

Anthropicはこの措置を「違法な報復」として連邦裁判所に提訴。3月25日の審問では、担当判事のRita Lin氏が政府の対応を厳しく批判しました。「Anthropicを潰そうとしているように見える」「この契約紛争を公の場に持ち出したことへの懲罰であり、憲法修正第1条(言論の自由)の侵害にあたる可能性がある」と述べています。

政府側の弁護士Eric Hamilton氏は「AnthropicがClaudeのソフトウェアを操作し、国防総省が期待する動作をしなくさせるのではないかという懸念がある」と主張しました。しかしLin判事は、指定の範囲が「表明された安全保障上の懸念に対して適切に絞られていない」点を「問題がある」と指摘しています。

また注目すべきは、Hamilton弁護士がHegseth長官の投稿について「国防総省と無関係な業務においてAnthropicの利用を禁止する法的権限はない」と認め、なぜそのような投稿をしたのかについては「わからない」と述べた点です。

国防総省は今後、Anthropicの代替としてGoogle、OpenAI、xAI(イーロン・マスク氏のAI企業)の技術を採用する方針を示しています。

なぜ今、この問題が重要なのか

この裁判は、単なる企業と政府の契約紛争にとどまりません。AIが軍事・安全保障の現場に深く組み込まれていく中で、「AI企業はどこまで自社技術の使われ方に関与できるか」という問いに、初めて法的な答えが求められているのです。

これまでAI企業は、倫理的なガイドラインや利用規約を通じて技術の使われ方をある程度コントロールしてきました。しかし国家安全保障という名の下では、そのコントロールが「妨害行為」と見なされるリスクがあることが、今回の事例で明らかになりました。

47億ドル規模とも言われる米軍のAI調達市場において、今後どの企業が生き残るかは、技術力だけでなく「政府との関係性」にも大きく左右されることになりそうです。

日本への影響という観点では、ソニーや富士通、NTTといった企業が欧米のAI基盤を利用したサービスを展開している現状を踏まえると、米国政府がAI企業の行動を規制・制裁できる範囲が広がることは、日本企業のサプライチェーンリスク管理にも直結します。日本の防衛省が米国製AIを調達・活用する場面でも、類似の政治的リスクが生じる可能性を否定できません。

各ステークホルダーの視点

AI企業の立場から見れば、今回の事態は「倫理的な懸念を表明すること自体が、政府との関係を壊すリスクになる」という前例を生みかねません。特に、軍事契約を持つ、あるいは持とうとする企業にとっては、自社の価値観と政府の要求のどちらを優先するかという岐路に立たされることになります。

国防総省の立場は、AIが「期待通りに動作しない可能性」を安全保障上の脅威と捉えるものです。戦場でAIが突然異なる判断を下すリスクは現実的であり、軍としての懸念自体は理解できます。ただし、Lin判事が指摘するように、その懸念に対する対応が「比例原則」を守っているかどうかは別問題です。

競合他社(OpenAI、Google、xAI)の立場は複雑です。Anthropicの排除により短期的に政府契約を得る機会が生まれる一方、「政府に従順でない企業は排除される」という前例は、自社にも将来的に適用されうるリスクを意味します。

一般市民・社会の視点では、AIが軍事意思決定にどこまで関与するのかという透明性の問題が浮かび上がります。Anthropicが「公の場に持ち出した」ことで初めてこの議論が可視化されたとすれば、企業の「声を上げる行為」自体が民主主義的な機能を果たしていると言えるかもしれません。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が終結。陪審員は「時効切れ」と判断したが、法廷で暴露された内幕はAI業界全体の成熟度に疑問を投げかけている。

SpaceXとAnthropicの15兆円規模のコンピュート契約が明らかに。AI開発の「インフラ戦争」が激化する中、日本企業はどう生き残るのか。

イーロン・マスクがOpenAIとサム・アルトマンCEOを訴えた裁判で敗訴。非営利から営利への転換をめぐる法廷闘争は、AIガバナンスの根本的な問いを世界に突きつけた。日本企業への示唆も含め解説。

中国がNvidiaのゲーミングチップを禁輸リストに追加。ジェンスン・フアンCEOが訪中中のタイミングで下された決定が示す、米中半導体覇権争いの深層を読む。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加