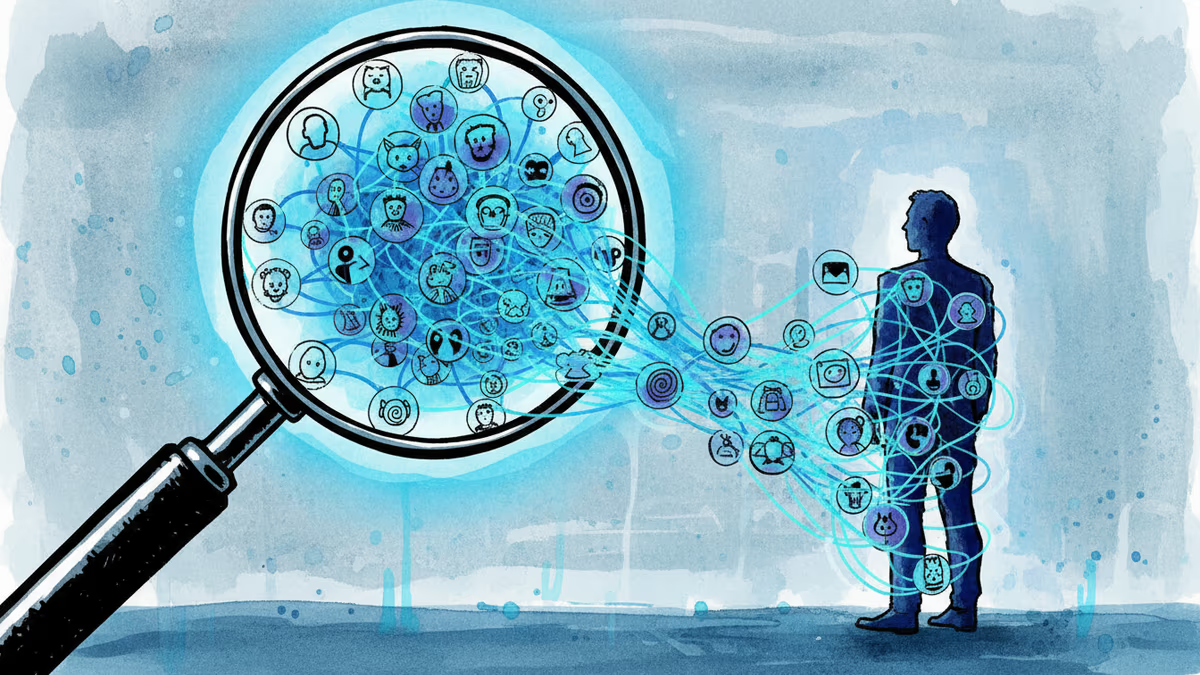

AIが偽名アカウントを90%の精度で特定 - デジタル匿名性の終焉か

AI技術により偽名SNSアカウントの特定精度が90%に達し、インターネット上の匿名性が根本的に脅かされる可能性が明らかに。プライバシー保護の新たな課題とは。

68%のユーザーが特定され、90%の精度で身元が判明する。これは、AIによる偽名アカウント特定技術の現在の成果です。インターネット上の匿名性という、私たちが当然視してきた前提が、根本的に揺らいでいます。

従来の匿名化手法の限界

最新の研究論文によると、複数のソーシャルメディアプラットフォーム間でアカウントや投稿を関連付けることで、偽名ユーザーの特定が可能になりました。従来の匿名化解除作業は、人間が構造化データセットを組み立てたり、熟練した調査員による手作業に依存していました。しかし、AI技術の進歩により、この状況は劇的に変化しています。

リコール率(成功的に匿名化解除されたユーザーの割合)は最大68%に達し、プレシジョン(正確にユーザーを特定した推測の割合)は90%まで向上しました。この数値は、従来の手法を大幅に上回る成果です。

日本社会への影響

日本では、匿名性を活用した議論文化が根強く存在します。2ちゃんねるから始まり、現在のX(旧Twitter)まで、多くの日本人が偽名や匿名でセンシティブな話題について発言してきました。この研究結果は、そうした文化的基盤を揺るがす可能性があります。

特に懸念されるのは、企業の内部告発者や政治的な意見を表明する市民への影響です。日本の企業文化では、直接的な批判や告発が困難な場合が多く、匿名性が重要な役割を果たしてきました。AI技術による特定が容易になれば、こうした声が萎縮する可能性があります。

テクノロジー企業の対応

ソニーや任天堂などの日本の大手テクノロジー企業は、この技術の発展をどう受け止めているでしょうか。一方では、自社プラットフォームのセキュリティ向上や不正アカウント検出に活用できる可能性があります。他方で、ユーザーのプライバシー保護という観点から、新たな対策の必要性に直面しています。

企業にとって重要なのは、技術的な可能性と倫理的責任のバランスです。AI技術の進歩を活用しつつ、ユーザーの信頼を維持するための新しいアプローチが求められています。

プライバシー保護の新たな挑戦

従来の偽名使用という「不完全だが十分な」プライバシー保護手段が、もはや有効でない可能性が高まっています。この変化は、ドキシング(個人情報の暴露)、ストーキング、詳細なマーケティングプロファイルの作成といったリスクを増大させます。

日本の法的枠組みも、この技術的変化に対応する必要があります。個人情報保護法の見直しや、AI技術の倫理的利用に関するガイドライン策定が急務となるかもしれません。

関連記事

米国防総省が確認:敵対勢力が商業的位置情報データを使い、戦場の米軍兵士を追跡・監視。広告テクノロジー産業が「国家安全保障上の脅威」として問われ始めた。

ブラウザのサイドチャネル攻撃「FROST」が、SSDのタイミング計測により閲覧履歴やアプリ情報を盗み見る。一般ユーザーから企業まで影響する新手法を解説。

MetaがInstagram・Facebook・WhatsAppの有料プランを全世界展開。月額399〜299円のサブスクが私たちのSNS利用をどう変えるのか、その背景と影響を読み解く。

米FTCがCoxメディアなど3社に対し、スマートデバイスで会話を盗聴して広告ターゲティングに使用したと虚偽宣伝した疑いで総額93万ドルの制裁金を科しました。プライバシー広告の実態と日本への示唆を解説します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加