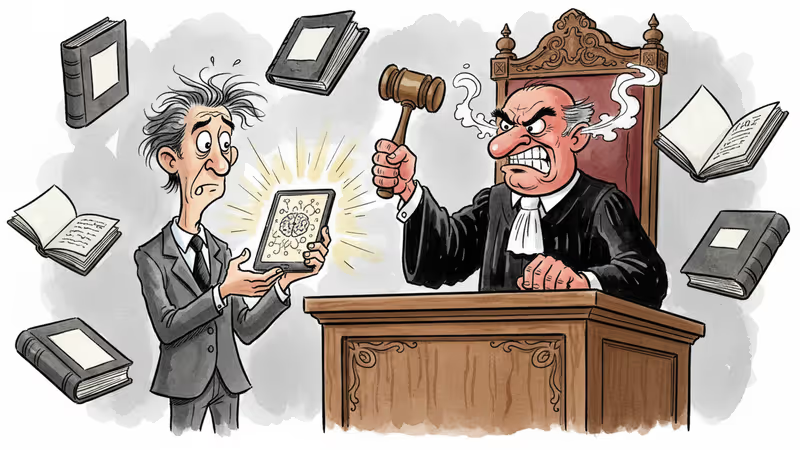

AI誤用で訴訟打ち切り、弁護士の職業倫理に新たな課題

ニューヨーク連邦裁判所がAI誤用により訴訟を打ち切り。法曹界におけるAI利用の新たなガイドライン必要性が浮き彫りに。

偽の判例引用とレイ・ブラッドベリの『華氏451度』への唐突な言及に満ちた華麗すぎる文章に業を煮やしたニューヨーク連邦裁判所の判事が、弁護士のAI誤用を理由に訴訟そのものを打ち切るという異例の制裁措置を下した。

偽の判例引用が招いた異例の制裁

キャサリン・ポーク・ファイラ連邦地裁判事は木曜日の命令で、弁護士のスティーブン・フェルドマン氏が書面の訂正要求に対し、繰り返し偽の判例引用を含む文書で応答したため、異例の制裁措置が正当化されると判断した。

ファイラ判事が特に問題視したのは、フェルドマン氏の提出書面の一つが「著しく華麗な文体」で書かれていた点だ。通常の書面に見られる文法的誤りや冗長な文章とは対照的に、この書面は文体的に明らかに異質だった。

判事の指摘は法曹界に重要な問題を提起している。AIが生成した文章の特徴的な「華麗さ」や不自然な文学的言及は、もはや隠しきれないほど明白になっているのだ。

法曹界のAI利用、規制の空白地帯

今回の事件は、法曹界におけるAI利用が急速に広がる一方で、適切な規制やガイドラインが追いついていない現実を浮き彫りにした。2023年以降、ChatGPTをはじめとする生成AIの普及により、多くの弁護士が文書作成にAIを活用し始めている。

しかし、AIが生成する「もっともらしい嘘」、いわゆる「ハルシネーション」問題は深刻だ。存在しない判例を引用したり、事実と異なる法的解釈を提示したりするケースが世界各地で報告されている。

日本でも同様の懸念が高まっている。日本弁護士連合会は2023年にAI利用に関する指針を発表したが、具体的な制裁措置については明確化されていない部分が多い。

職業倫理と技術革新の狭間で

今回の判決が示すのは、単なる技術的問題を超えた職業倫理の根本的な問い直しだ。弁護士の職責は依頼人の利益を最大化することだが、それは真実と正確性を犠牲にして良いという意味ではない。

AIツールの利用自体は問題ではない。むしろ効率性や アクセシビリティの向上につながる可能性がある。問題は、その出力を盲目的に信頼し、必要な検証を怠ることだ。

法曹界以外でも同様の課題が浮上している。医療分野では誤診のリスク、教育分野では学術的不正の懸念、ジャーナリズムでは誤情報の拡散など、各専門職がAI時代の職業倫理を再定義する必要に迫られている。

関連記事

IBMとスクーデリア・フェラーリHPのパートナーシップが、F1ファンアプリをAIで刷新。62%のエンゲージメント増加の裏に何があるのか。スポーツとAIの融合が示す企業戦略の新潮流を読み解く。

AnthropicのCode with Claudeイベントで、参加者の約半数がAIが書いたコードを確認せずにリリースしたと認めた。開発の未来と日本社会への影響を多角的に考察する。

MetaがiPhone向け新アプリ「Forum」を公開。Facebookグループ機能をAIチャットボットと組み合わせ、RedditやChatGPTへの対抗軸を形成。日本のコミュニティ文化への影響を読む。

米国で墜落死したパイロットの音声がAIで復元され、インターネット上に拡散。NTSBが公開記録システムを一時停止した事件が問いかける、技術と倫理の境界線。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加