AIに「ノー」と言ったら、政府に制裁された

米連邦判事がトランプ政権によるAI企業Anthropicへの制裁を一時停止。自律型兵器への懸念表明が「国家安全保障リスク」に認定された背景と、日本企業への影響を読み解く。

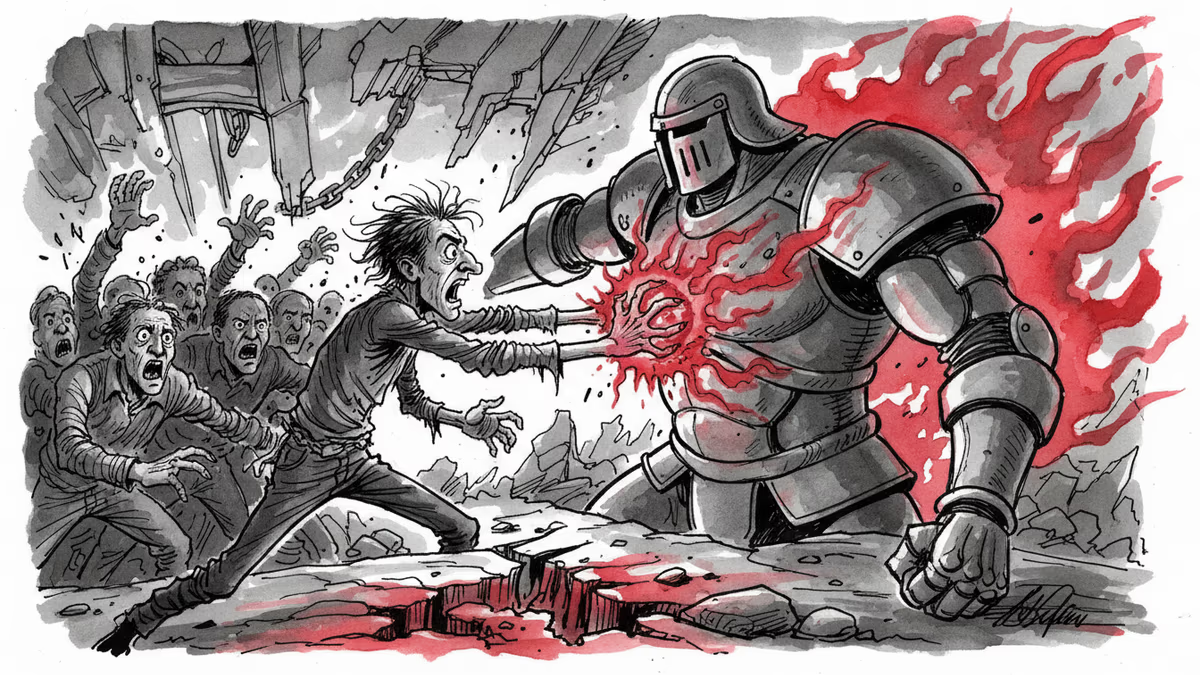

「自律型兵器には使わないでほしい」——そう申し出た企業が、米政府から「国家安全保障上の脅威」と指定される。これは、権威主義国家の話ではありません。2026年3月、アメリカで実際に起きたことです。

何が起きたのか

米連邦地裁のリタ・リン判事は3月27日、トランプ政権がAnthropic(アンソロピック)に科した制裁措置の一時停止を命じました。AnthropicはAIモデル「Claude(クロード)」を開発する米国の有力AI企業です。

事の発端は先月にさかのぼります。Anthropicが国防総省との契約交渉の中で、「大規模監視や完全自律型兵器システムへの自社技術の使用には同意できない」と表明したことでした。これに対し、ピート・ヘグセス国防長官はX(旧Twitter)上で「傲慢と裏切りのマスタークラス」と猛烈に批判。その後、トランプ政権はすべての連邦機関にAnthropic技術の使用を禁じる大統領令を発動し、さらに国防総省は同社を「サプライチェーン上の国家安全保障リスク」に指定しました。

この指定は通常、中国やロシアなど敵対的な外国組織に対して用いられるものです。米国企業に適用されるのは、極めて異例のことでした。さらに問題を複雑にしたのは、国防総省の全ての取引業者・請負業者が「Anthropic技術を使用していない」と証明する義務を負わされた点です。これは事実上、Anthropicを業界全体から締め出す措置でした。

リン判事は今週の審理で、政府が「報道での批判に対してAnthropicを罰しようとしている」可能性に懸念を示し、それは憲法上の表現の自由に違反すると指摘しました。判決文では、政府の指定を「恣意的かつ法律に反する可能性が高い」と断じ、「米国企業が政府の調達方針に異議を唱えただけで、潜在的な敵国とみなされうるという『オーウェル的』な発想は、いかなる法的根拠も持たない」と記しました。今回の一時停止命令は7日間有効で、政府側が緊急上訴する時間を確保するものです。

なぜ今、この問題が重要なのか

この事件は、単なる一企業と政府の法廷闘争ではありません。AIの軍事利用をめぐる、より根本的な問いを私たちに突きつけています。

Anthropicが懸念を示した「完全自律型兵器システム」とは、人間の判断を介さずにターゲットを選定・攻撃できるシステムを指します。国際的には「キラーロボット」とも呼ばれ、多くの国が規制を求めています。AI企業がこうした倫理的な一線を引くことは、業界の自主規制として評価されてきた側面があります。しかし今回、その姿勢が政府との対立を招き、制裁という形で跳ね返ってきました。

テック業界は概ねAnthropicを支持しています。もし今回の制裁が維持されていれば、「政府の方針に異を唱えた企業は市場から排除される」という前例が生まれていたからです。これは企業の自己検閲を促し、AI開発の方向性を政府の意向に沿わせる強力な圧力になり得ます。

日本企業はどう見るべきか

この問題は、日米同盟の深化とともにAI・防衛分野での協力を模索する日本企業にとっても、決して対岸の火事ではありません。

ソニー、富士通、NTTなど、米国の防衛関連企業との取引を持つ日本企業は、今後「Anthropic技術を使用していない」という証明を求められる可能性がありました。今回の一時停止でその危機は当面回避されましたが、最終的な司法判断によっては状況が変わります。

より広い視点で見れば、日本のAI開発においても「どこまでを軍事利用に許容するか」という問いは避けられません。日本政府は2023年にAI戦略を改定し、防衛分野へのAI活用を推進する方向を打ち出しています。国内AI企業が将来、同様の倫理的判断を迫られたとき、今回の米国の事例は重要な参照点になるでしょう。

また、日本の研究機関や大学がClaudeを研究・教育目的で使用している場合、制裁が維持されれば間接的な影響を受ける可能性もありました。AI基盤モデルへの依存度が高まる中、特定のモデルが政治的な理由で突然使えなくなるリスクは、日本の研究・産業界にとっても現実的な課題です。

異なる視点から考える

国防総省の立場から見れば、軍事契約においてベンダーが使用条件に制限を設けることは、作戦上の柔軟性を損なうと映るかもしれません。「契約上の合意なき批判」は、政府調達の信頼性を揺るがすという論理も成り立ちます。

一方、Anthropicの創業者たちはもともと、AI安全性を最重要課題としてOpenAIから独立した経緯があります。同社にとって、倫理的な使用制限は単なる商業判断ではなく、企業の存在意義そのものです。その一線を政府の圧力で曲げることは、企業としての根幹を失うことを意味します。

国際社会から見れば、この事件は「民主主義国家でも、政府はAI企業に対して強制的な影響力を行使できる」という現実を示しています。中国政府がAI企業を規制・管理することへの批判と、今回の米国の行動をどう整合させるか——これは欧州や日本の政策立案者にとっても難しい問いです。

記者

関連記事

中国系サイバー諜報作戦「Shadow-Earth-053」がアジア7カ国と NATO加盟国ポーランドの政府・防衛ネットワークに侵入。ウイグル人や台湾人活動家への標的型フィッシングも並行実施。日本の安全保障と企業への示唆を読み解く。

2026年5月7日、英米ノルウェーが同日に中国の越境弾圧に対して法的・安全保障上の措置を取った。偶然の一致が浮き彫りにする、民主主義陣営の連携の必要性を読み解く。

中国がMetaによるAIスタートアップManus買収を阻止。5月14日の習近平・トランプ首脳会談を前に、北京の戦略的意図と日本企業への影響を多角的に分析します。

中国が「旧三品」から「新三品」、そして「新新三品」へと産業をアップグレードし続ける背景には、補助金以上の構造的要因がある。日本企業と日本社会への影響を多角的に読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加