AIがサイバー防衛を変える:後付けでは間に合わない

AIの普及でサイバー攻撃の規模と複雑さが急増。従来型セキュリティの限界が露呈する今、AI設計の根幹に組み込む「AI-Native」アプローチが求められている。日本企業への影響を解説。

あなたの会社のセキュリティ担当者は、今この瞬間も人間が処理できる速度の1,000倍以上で動くAI攻撃と戦っているかもしれない。

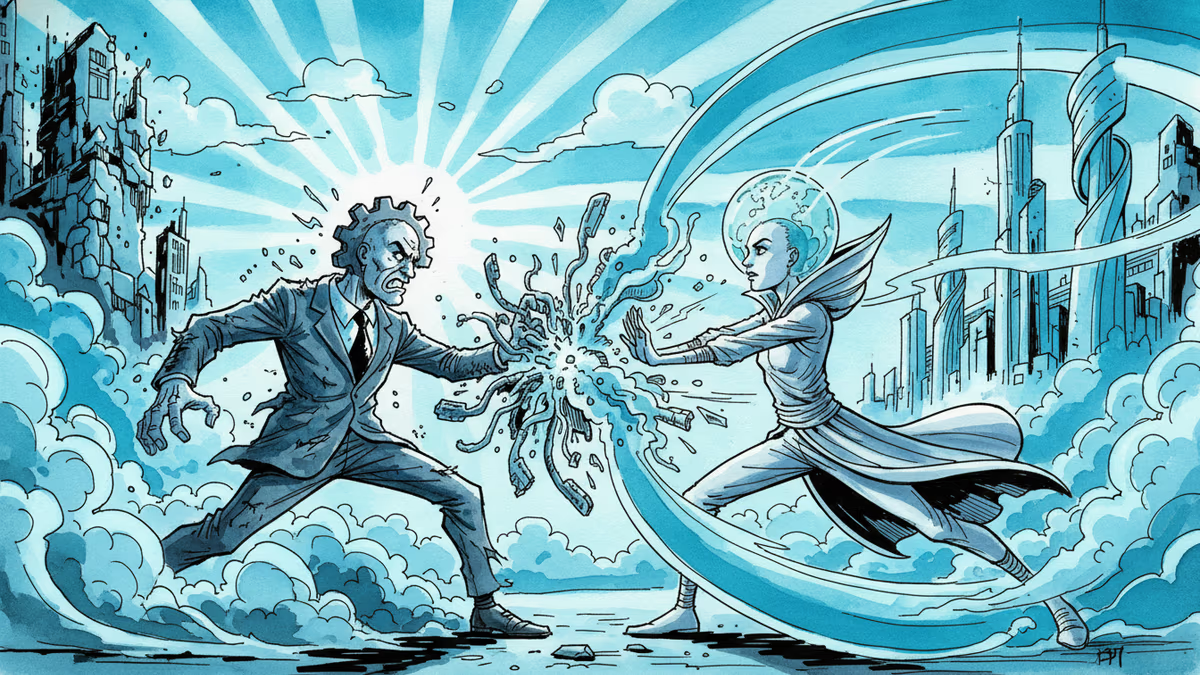

AIは「守る側」だけの武器ではない

MITテクノロジーレビューが主催するEmTech AIカンファレンスで、GC Cybersecurityの共同創業者兼CEO/CTOであるTarique Mustafa氏は、現代のサイバーセキュリティが直面する根本的な矛盾を指摘した。AIは企業の業務効率を高める一方で、攻撃者にも同じ能力を与えている。問題は、多くの企業が依然として「AIを後から追加する」アプローチでセキュリティを構築していることだ。

Mustafa氏はUSC(南カリフォルニア大学)で知識表現と推論計算を専攻し、SymantecやMCI WorldComなどでのキャリアを経て、自律型AIをサイバーセキュリティに応用することに20年以上を費やしてきた。彼が強調するのは単純な事実だ。「AIが攻撃面(アタックサーフェス)を拡大し、新たな複雑性を加えている今、従来型のアプローチの限界はもはや無視できない。」

具体的に何が変わったのか。従来のサイバー攻撃は、人間のハッカーが手動でシステムの脆弱性を探すプロセスを含んでいた。しかしAIを活用した攻撃ツールは、数秒で数百万のエンドポイントをスキャンし、ゼロデイ脆弱性を自動的に発見・悪用できる。データ漏洩(DLP)の文脈では、機密データがどこに存在し、どのように動いているかを把握すること自体が、AIなしには不可能なほど複雑になっている。

「後付けセキュリティ」の構造的欠陥

多くの企業が取るアプローチはこうだ。まずビジネスシステムやAIツールを導入し、その後にセキュリティ層を「追加」する。これは建物を建ててから防火設備を考えるようなものだ。

Mustafa氏が開発したGC Cybersecurityの第4・第5世代の完全自律型データ漏洩防止プラットフォームは、このパラダイムへの直接的な回答だ。AIが設計の中心に置かれ、データの分類(Data Classification)、損失防止(DLP)、セキュリティ態勢管理(DSPM)が統合的に機能する。人間のアナリストが個別のアラートを確認するのではなく、AIが自律的に脅威を検知・対応・学習するサイクルを回す。

このアプローチが特に重要になるのが、超大規模環境においてだ。グローバル展開する企業では、1日に処理されるデータ量とネットワークイベントの数は、人間チームが監視できる閾値をはるかに超えている。AIによる自律的な協調(Autonomously Collaborative AI)なしには、リアルタイムの脅威対応は事実上不可能だ。

日本企業にとってこの問題は特に切実だ。トヨタ、ソニー、NTTといった大企業はグローバルなサプライチェーンを持ち、サードパーティ経由の侵害リスクにさらされている。2022年にはトヨタのサプライヤーへのサイバー攻撃が国内全14工場の操業停止を引き起こした。あの事例は「後付けセキュリティ」の脆弱性を象徴的に示している。

なぜ「今」なのか:AIの民主化が意味すること

サイバーセキュリティの問題は以前から存在していた。では、なぜ2025〜2026年が転換点なのか。

答えは「AIの民主化」にある。高度な攻撃ツールの開発に以前は専門的な技術知識と多大なコストが必要だったが、生成AIの普及により、技術的素養の低い攻撃者でも洗練されたフィッシングメール、マルウェアコード、ソーシャルエンジニアリングスクリプトを生成できるようになった。攻撃の「敷居」が劇的に下がった一方、その「規模」は指数関数的に拡大している。

さらに、企業内でのAI活用が進むほど、機密データが新たなシステムやクラウド環境に分散し、管理されるべきデータの所在が曖昧になる。Mustafa氏のもう一つの会社、Chorologyが取り組むデータコンプライアンスの問題も、この文脈で理解できる。データがどこにあるかわからなければ、守ることもできない。

日本の文脈では、2025年に改正された個人情報保護法の施行強化と、政府のサイバーセキュリティ戦略の見直しが重なるタイミングだ。経済産業省が推進するDX(デジタルトランスフォーメーション)と、それに伴うセキュリティリスクの増大は、多くの日本企業が同時に直面している現実だ。労働力不足が深刻な日本において、人間のセキュリティアナリストへの依存を減らし、AIが自律的に動くアーキテクチャへの移行は、経済合理性の観点からも避けられない選択になりつつある。

異なる視点も存在する。自律型AIによるセキュリティ対応には、AIが誤検知によって正常なビジネスプロセスを遮断するリスクや、AIシステム自体が攻撃対象になる「AI poisoning」の問題がある。完全な自律化への移行を慎重に見る専門家も少なくない。また、中小企業にとって高度なAIセキュリティプラットフォームの導入コストは依然として高く、セキュリティ格差の拡大を懸念する声もある。

本コンテンツはAIが原文記事を基に要約・分析したものです。正確性に努めていますが、誤りがある可能性があります。原文の確認をお勧めします。

関連記事

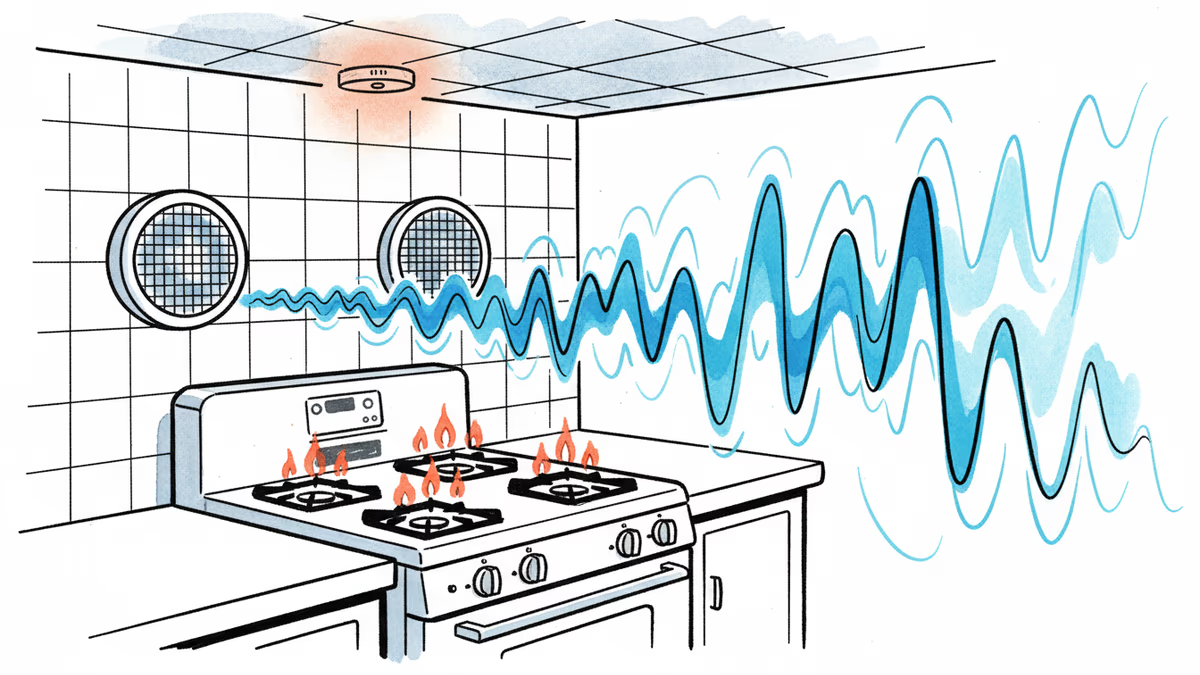

カリフォルニアで実証されたAI駆動の音響消火技術。超低周波音(インフラサウンド)が酸素分子を燃料から引き離し、炎を数秒で消す。日本の高齢化社会や木造住宅密集地への応用可能性を探る。

ディズニーランドが顔認証システムを導入。「任意」とされるその仕組みは、本当に自由な選択を保証しているのか。テクノロジーと日常空間のプライバシーをめぐる問いを考えます。

イラン無人機攻撃でアマゾンのデータセンターが被害を受けた2026年3月、イラクの通信会社が石油パイプラインに沿って敷設した光ファイバー回線がクラウドサービスの「生命線」として機能した。日本企業への影響と、インターネットインフラの地政学的脆弱性を読み解く。

MetaがヒューマノイドロボットスタートアップARIを買収。AGI実現に向けた「身体」の争奪戦が加速する中、日本企業はどう動くべきか。ロボット大国・日本への影響を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加