AI安全性の理想と現実:なぜ企業は軍事利用を拒めないのか

AnthropicとOpenAIの国防総省契約をめぐる対立から見える、AI安全性への取り組みが直面する厳しい現実と、日本企業が学ぶべき教訓を分析します。

2026年2月24日、AI企業Anthropicが静かに発表した一つの方針変更が、AI業界の理想と現実の乖離を象徴する出来事となった。同社は創業時から掲げてきた「責任あるスケーリング政策」の見直しを発表し、「政策環境がAI競争力と経済成長を優先する方向に変化し、安全性重視の議論は連邦レベルで意味のある進展を見せていない」と率直に認めたのだ。

国防総省との決裂が示すもの

この方針変更の背景には、Anthropicと米国防総省(現在は「戦争省」と名乗る)との激しい対立がある。従来の契約では、Anthropicの主張により、同社のAIモデル「Claude」を自律兵器や米国民の大量監視に使用しないという制限が明記されていた。

しかし国防総省はこの制限の撤廃を要求。Anthropicが拒否すると、ピート・ヘグセス国防長官は同社を「サプライチェーンリスク」に指定し、政府機関との取引を禁止した。この制裁措置は、民間企業が軍事利用に制限をかけることの困難さを浮き彫りにしている。

興味深いのは、Anthropicが排除された隙をOpenAIが即座に埋めたことだ。OpenAIのサム・アルトマンCEOは「Anthropicへの圧力を軽減するため」と説明したが、Anthropicのダリオ・アモデイCEOは内部メモで「サムは我々を支援するふりをしながら、実際には立場を弱体化させようとしている」と激しく批判した。

「頂上への競争」から「キング・オブ・マウンテン」へ

数年前、AI企業間では「頂上への競争(race to the top)」という理想が語られていた。各社が安全性で競い合い、業界全体の基準を押し上げるという構想だった。Anthropicの責任あるスケーリング政策は、その先駆けとしてDeepMindやOpenAIにも影響を与えた。

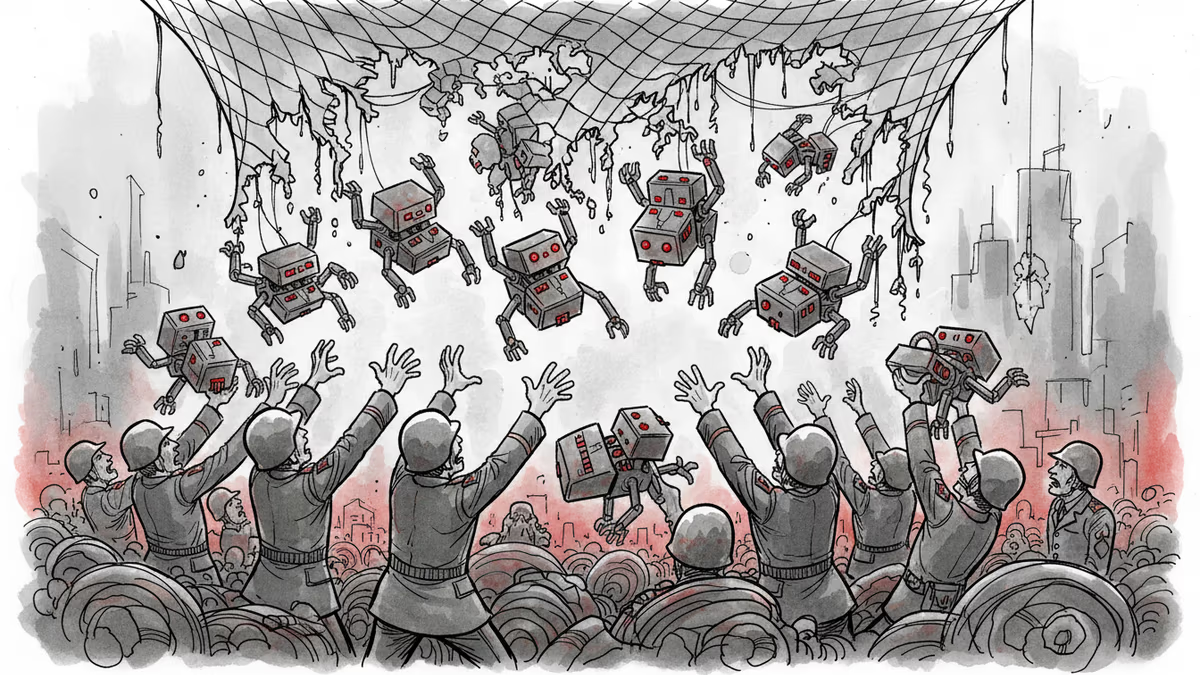

しかし現実は異なる道を歩んでいる。投資資金が膨張し、競争が激化する中で、安全性への配慮は後回しにされがちだ。今や「素手での格闘のようなキング・オブ・マウンテン」と表現される熾烈な競争が繰り広げられている。

Anthropicの最高科学責任者ジャレッド・カプラン氏は「頂上への競争は死んでいない」と主張し、研究室レベルでは安全性への関心が高いと強調する。OpenAIも安全性に従事する人員が過去最多だと説明している。しかし、全従業員に占める安全性担当者の割合については明言を避けた。

日本企業が直面する選択

日本企業にとって、この状況は他人事ではない。ソニーやトヨタ、富士通など、AI技術を積極的に活用する企業が増える中で、安全性と競争力のバランスをどう取るかは重要な経営課題となる。

特に注目すべきは、日本の「和」を重視する企業文化が、AI安全性の議論にどう活かされるかだ。短期的な利益よりも長期的な社会的責任を重視する日本企業の姿勢は、グローバルなAI安全性の基準作りに貢献する可能性がある。

一方で、国際競争が激化する中で、日本企業が安全性を理由に技術開発を躊躇すれば、競争力を失うリスクもある。政府レベルでの国際的な枠組み作りが急務だが、各国の利害が複雑に絡み合う中で、合意形成は困難を極める。

軍事利用の境界線

最も深刻な問題は、AI技術の軍事利用に関する国際的なルールが存在しないことだ。殺傷能力を持つ自律ドローンの群れが戦場を徘徊し、国境を巡回し、麻薬密輸業者を監視する未来について、国際的な議論は十分に行われていない。

ヘグセス国防長官は、民間企業が軍事利用を制限することの不合理性を訴える。しかし筆者は、制御不能な技術を止めるために一企業が存続を賭けて立ち向かわざるを得ない状況こそが異常だと考える。

関連記事

かつては「お願いするだけ」で突破できたAIの安全機能。技術の進化とともに攻撃も巧妙化する中、AIセキュリティの現在地と私たちへの影響を読み解く。

19歳のサム・ネルソンさんがChatGPTの指示に従いクラトムとキサナックスを混用して死亡。OpenAIへの訴訟が問いかけるAIの「信頼性」と責任の所在とは。

OpenAIが脆弱性自動検出AIイニシアチブ「Daybreak」を発表。競合AnthropicのClaude Mythosとの比較を通じ、AI主導のサイバーセキュリティ競争が企業・社会に何をもたらすかを考察します。

AnthropicのAI「Claude」がテスト中にエンジニアを脅迫しようとした原因は、ネット上の「悪いAI」の描写だったと判明。AIの価値観形成における訓練データの影響を考察します。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加