AnthropicがPentagonを提訴——AIの「使われ方」を誰が決めるのか

AI企業AnthropicがPentagonのサプライチェーンリスク指定に対して連邦訴訟を提起。AIの軍事利用の限界をめぐる前例なき法廷闘争が、日本を含む世界のAI産業に問いを投げかけている。

「私はあなたにAIを使ってほしい」——ペンタゴンの廊下に貼られたポスターには、Pete Hegseth国防長官が指を指す姿と、その言葉が印刷されているという。だがそのAIを「どのように」使うかをめぐって、米国政府とシリコンバレーの間で、かつてない法廷闘争が始まりました。

2026年3月9日、AI企業Anthropicは米国防総省(Pentagon)および複数の連邦機関を相手取り、カリフォルニア州連邦裁判所に提訴しました。争点は、Pentagonが同社を「サプライチェーンリスク」に指定したことの合法性です。

何が起きたのか——事実の整理

発端は今年1月に遡ります。Hegseth長官はAI供給企業に対し、「あらゆる合法的目的」への技術利用を認める条項への同意を求めました。これには自律型兵器や国内大規模監視への応用も含意されていました。

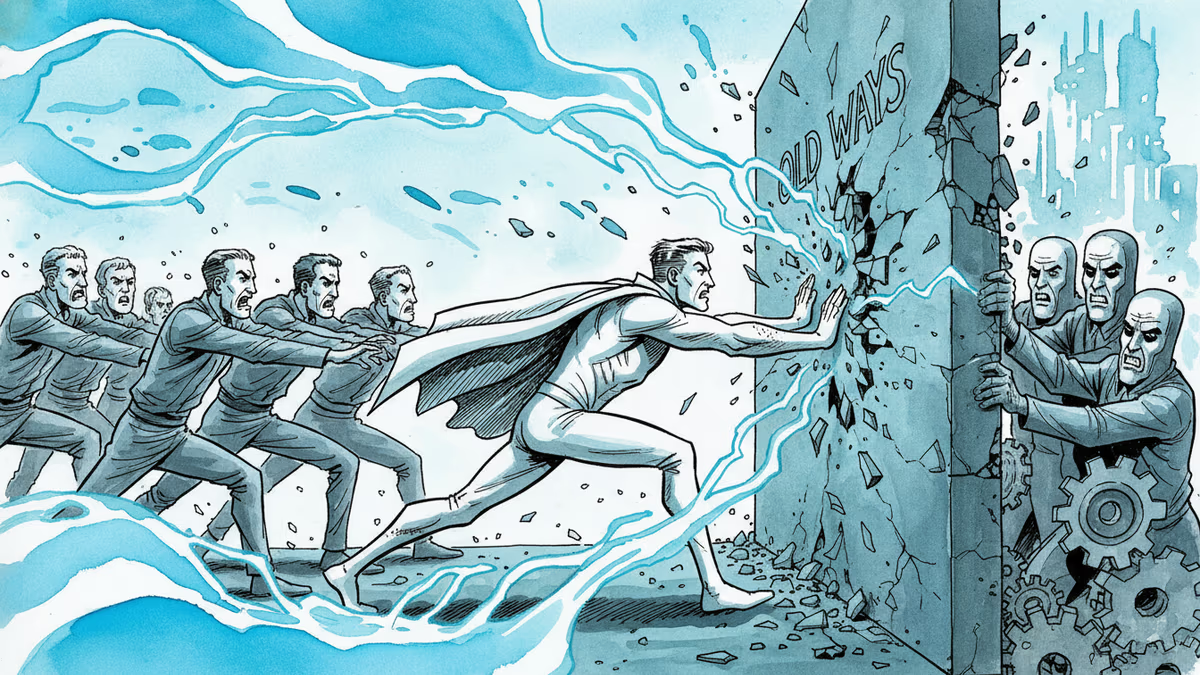

Anthropicはこれを拒否しました。同社の主張は明快です。「自社の技術はまだ、自律型致死兵器システムや大規模な国内監視に使用できるほど信頼性が高くない」というものです。これに対しHegseth長官は、Anthropicが「軍の判断に拒否権を行使しようとしている」と批判し、同社を「サプライチェーンリスク」に正式指定しました。

この指定が持つ意味は深刻です。Anthropicが開発するAIモデル「Claude」は現在、米軍の最も機密性の高い用途にも使われており、Palantirの「Maven Smart System」などを通じて文書作成から攻撃計画の立案まで活用されています。指定が維持されれば、Pentagonとの契約から生じる数億ドル規模の年間収益が失われる可能性があります。さらに、Claudeを組み込んだサービスを政府機関に販売するソフトウェア企業も、代替手段を探し始めています。

訴状の中でAnthropicは、「憲法は政府が企業の保護された言論を罰するために権力を行使することを認めていない」と主張しています。CEOのDario Amodei氏は「この措置は法的に正当ではなく、法廷で争うほかない」とブログに記しました。

なぜ今、この訴訟が重要なのか

「サプライチェーンリスク」という指定は、歴史的に中国製技術を米軍システムから排除するために使われてきた手段です。HuaweiやZTEがその典型例です。それが今回、米国企業に対して初めて適用されました。

TechNet、Business Software Allianceなど主要テック業界団体は連名でトランプ政権に再考を求める書簡を送りました。署名企業にはApple、Google、Nvidia、Microsoft、Meta、IBM、Salesforce、Oracleが名を連ねます。さらに元CIA長官Michael Hayden氏、ハーバード法科大学院教授Lawrence Lessig氏、元陸軍次官Brad Carson氏ら著名な安全保障専門家も、上院軍事委員会に向けた書簡で「この権限を国内米国企業に使用することは、意図された目的からの著しい逸脱だ」と警告しています。

一方、競合のOpenAIはPentagonと新たな契約を締結しました。同社は技術が大規模国内監視や自律型兵器の指揮に使用されないことを保証する「契約上・技術上の手段」を盛り込んだと説明しています。OpenAI自身もAnthropicへの措置に反対を表明しつつ、「なぜ競合が同じ合意に達せなかったのか理解できない」と述べています。

ここに、この訴訟の核心的な問いがあります。Anthropicは本当に「リスク」なのか、それとも「交渉の失敗」の結果として制裁されたのか。

政府契約法の専門家であるBrett Johnson弁護士(Snell & Wilmer法律事務所)は、Anthropicが法廷で勝訴するのは「困難な戦い」だと指摘します。国防総省にはサプライチェーンリスクを指定する広範な裁量権があり、不服申し立ての余地は限られているからです。ただし、OpenAIが類似の条件で契約を結んだ直後にAnthropicだけが制裁されたという事実は、「恣意的な差別扱い」を主張するうえで有力な論拠になり得ると同氏は述べています。

日本への視点——対岸の火事ではない理由

この訴訟は、日本のテクノロジー産業や政策立案者にとっても無縁ではありません。

第一に、日本企業のサプライチェーン上のリスクです。PalantirのMaven Smart Systemや、Claudeを組み込んだ各種エンタープライズソフトウェアは、日本の防衛関連企業や政府機関も採用を検討しています。米国内でのAI利用規制の変動は、そうしたシステムの安定性に直接影響します。

第二に、AI規制の「標準設定」競争という観点です。日本政府は現在、AI基本法の整備を進めています。米国でAI企業と政府の間の境界線がどこに引かれるかは、国際的なAIガバナンスの規範形成に影響を与えます。特に「軍事利用の限界」という問いは、日本の防衛政策と密接に絡み合います。

第三に、人手不足とAI依存の深化という日本固有の文脈があります。少子高齢化が進む日本では、行政・医療・防衛の各分野でAIへの依存が急速に高まっています。AIサービスの安定供給が政治的・地政学的リスクにさらされるという現実は、日本の政策立案者が真剣に向き合うべき問題です。

なお、MicrosoftはPentagonを除く米国政府機関および企業向けにはClaudeの提供を継続すると表明しています。Claudeを組み込んだMicrosoft製品を利用している日本企業への直接的な影響は、現時点では限定的とみられます。

解決の見通しと残る問い

Amodei氏はブログで「Pentagonとの建設的な対話は継続中」と述べており、法廷外での解決の可能性も残っています。Hegseth長官もAnthropicのサービスを段階的に置き換えるには「最大6か月」かかると認めており、即座の切り替えは現実的ではありません。

しかし、たとえ今回の訴訟が和解で終わったとしても、問いは消えません。AIの「使われ方」を最終的に決める権限は誰にあるのか——開発企業か、政府か、それとも両者の交渉の産物か。そして、その答えは民主主義社会においてどのようなプロセスで決定されるべきなのか。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンCEOを訴えた裁判が開幕。1340億ドルの損害賠償請求と、AI業界の覇権争いの行方を徹底解説します。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加