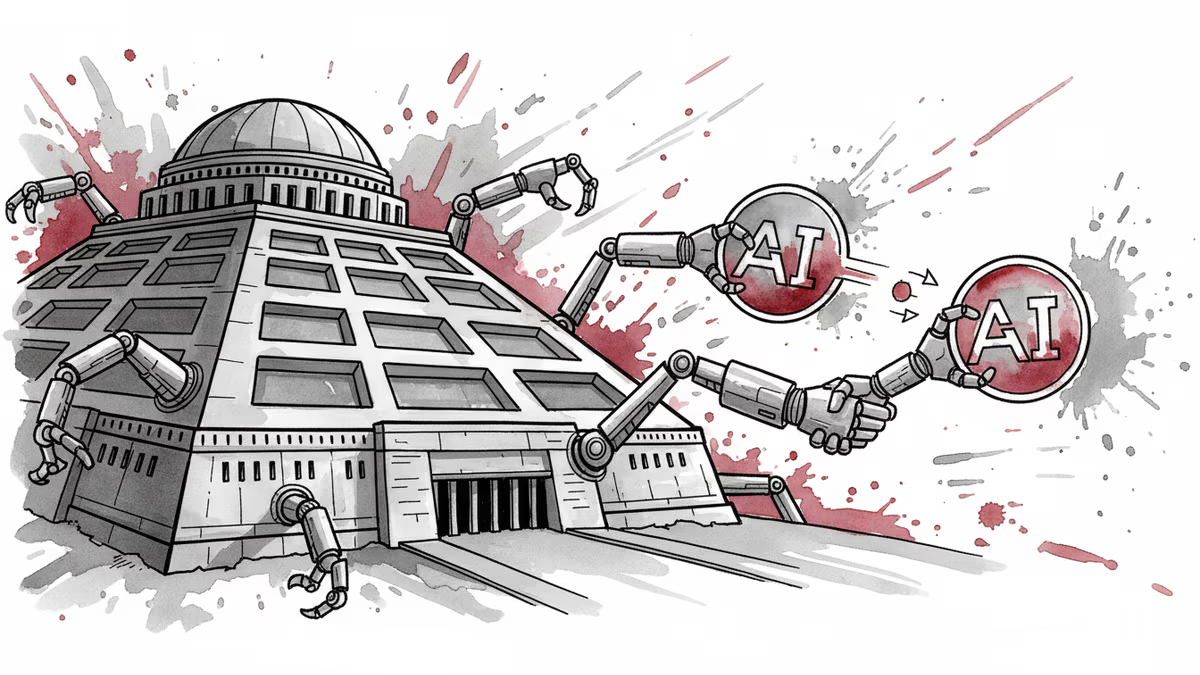

ペンタゴンがAI企業を「供給リスク」認定、軍事利用の境界線はどこに?

米国防総省がAnthropic社を供給リスク指定し、OpenAIとの契約に切り替え。ChatGPTアンインストール急増の背景と軍事AI利用の複雑な現実を探る。

2億ドルの契約が決裂した瞬間、AI業界の新たな分岐点が浮き彫りになった。米国防総省(ペンタゴン)がAnthropic社を「供給チェーンリスク」として正式に指定し、代わりにOpenAIとの契約を締結したのだ。その直後、ChatGPTのアンインストール数が295%急増している。

決裂の核心:制御権をめぐる攻防

契約破談の理由は明確だった。ペンタゴンが求めたのは、AIモデルに対する「無制限のアクセス権」。これには自律兵器システムでの使用や、国内での大規模監視活動への適用も含まれていた。Anthropicはこの条件を拒否し、結果として「供給リスク企業」の烙印を押された。

一方でOpenAIは同様の条件を受け入れた。しかし、この決定は一般ユーザーの強い反発を招いている。295%というアンインストール数の急増は、AI企業が直面する新たなジレンマを象徴している。

日本企業への波及効果

ソニーやソフトバンクなど、AI技術に投資する日本企業にとって、この動きは看過できない。米国防総省との関係は、単なる契約以上の意味を持つ。「供給リスク」認定は事実上のブラックリスト入りを意味し、今後の技術開発や国際展開に長期的な影響を与える可能性がある。

特に注目すべきは、日本政府が進める「AI戦略2024」との整合性だ。防衛装備庁も独自のAI研究を進める中、米軍との技術協力と民間企業の倫理的立場をどう両立させるかが問われている。

ユーザーの選択が示すもの

ChatGPTのアンインストール急増は、技術の軍事利用に対する一般市民の懸念を反映している。しかし、これは単純な善悪の問題ではない。AI技術は既に医療、教育、災害対応など、社会の重要な分野で活用されている。軍事利用を完全に拒否することで、これらの有益な応用まで制限されるリスクもある。

日本のユーザーにとって、この問題はより複雑だ。平和憲法を持つ日本では、軍事技術への関与に対する感情的な抵抗が強い。一方で、中国や北朝鮮の脅威が現実化する中、防衛技術の向上は国家安全保障の観点から不可欠でもある。

関連記事

ローマ法王レオ14世の初回回勅にAnthropicの共同創業者が登壇。宗教とシリコンバレーの異例の接近が示す、AIガバナンスの本質的な問いとは。

ローマ教皇レオ14世の回勅「マニフィカ・ウマニタス」はAIを技術問題ではなく人間の尊厳と権力の問題として捉え、アルゴリズムによる支配への警鐘を鳴らしています。日本社会への示唆を読み解きます。

ローマ教皇レオ14世が初の回勅「マニフィカ・フマニタス」を発表。Anthropic共同創業者の立ち会いのもと、AIの「武装解除」を訴えたその真意とは。AI倫理・社会的影響を4万語で論じた歴史的文書を読み解く。

教皇レオ14世が初の回勅「Magnifica Humanitas」でAIの危険性を警告。AI兵器、労働への影響、法的枠組みの必要性を論じた文書が世界に問いかけるものとは。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加