AIに「監視するな」と言える会社は存在できるか

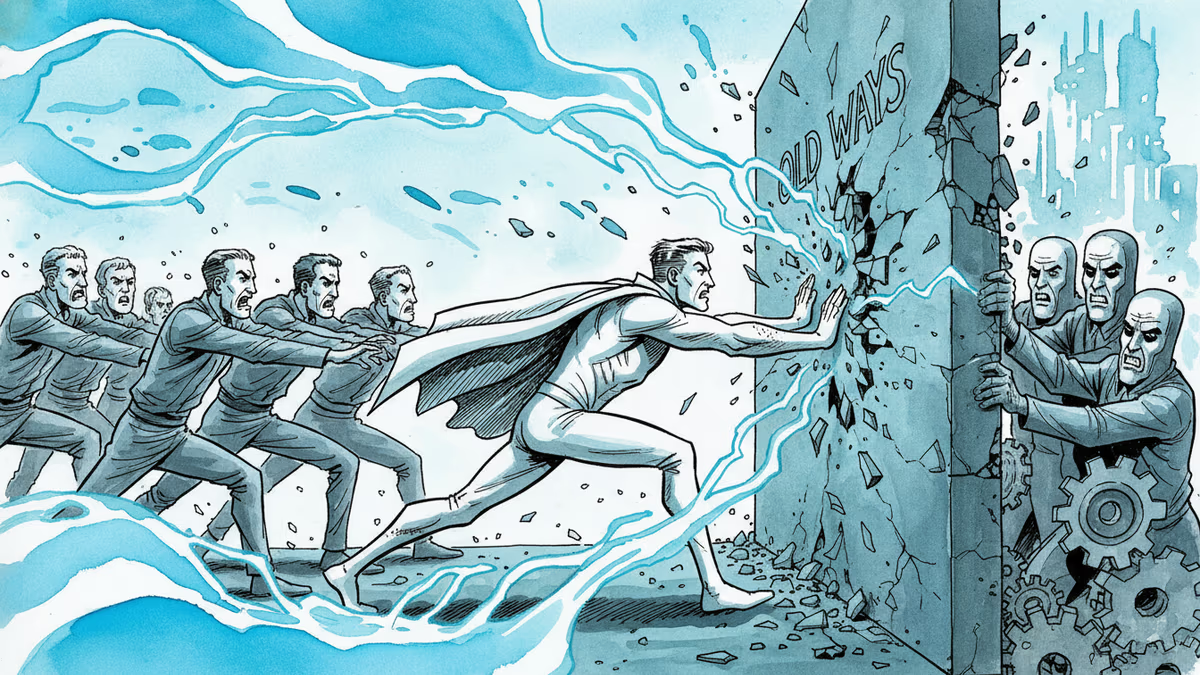

Anthropicがペンタゴンからサプライチェーンリスクに指定され訴訟へ。NSAの大量監視の歴史とAIの融合が問う、民間企業による「倫理的拒否権」の限界とは。

「すべての合法的な用途に使用します」——この一文が、世界最先端のAI企業の命運を左右することになるとは、誰が予想しただろうか。

何が起きたのか:静かな契約交渉が法廷闘争へ

Anthropicは、Claudeを開発するAI企業だ。安全性を重視する姿勢で知られ、OpenAIの元幹部たちが設立した。そのAnthropicが今、アメリカ国防総省(ペンタゴン)との間で激しい法廷闘争を繰り広げている。

事の発端は、ペンタゴンとの契約拡大交渉だった。Anthropicはすでに政府との取引実績があり、国防関連の契約も複数保有していた。しかし今回の交渉で、同社のCEO ダリオ・アモデイは二つの「レッドライン(越えてはならない一線)」を設けた。一つは自律型兵器への利用。もう一つが、大量監視への利用だ。

ペンタゴンはこの条件を拒否しただけでなく、Anthropicを「サプライチェーンリスク」に指定した。本来この指定は、中国系ネットワーク企業など外国の悪意ある供給者を排除するための制度だ。それをアメリカ国内企業の「倫理方針」に適用したのである。Anthropicは即座に訴訟を起こし、「政府は世界最速で成長するプライベート企業の経済的価値を破壊しようとしており、憲法修正第1条および第5条に違反する」と主張している。

一方、競合のOpenAIは「すべての合法的な用途に応じる」と表明し、ペンタゴンとの契約を獲得した。サム・アルトマンCEOは「Anthropicには2つのレッドラインがあったが、我々には3つあり、政府はすべて受け入れた」と述べた。しかしその後、この発言は徐々に後退しつつある。

なぜ「合法」という言葉が信用できないのか

ここで理解しておくべき重要な歴史がある。アメリカの監視体制がどのように拡大してきたか、だ。

9.11後の愛国者法(パトリオット法)、レーガン政権時代の大統領令12333、そして秘密裁判所であるFISA裁判所——これらが積み重なって、NSA(国家安全保障局)は独自の「辞書」を作り上げた。一般人が「ターゲット」という言葉を聞けば、「監視対象の特定個人」と理解する。しかしNSAの解釈では、「外国人に言及するすべての通信」がターゲットに含まれる。あなたが友人へのメッセージで外国人の名前を出した瞬間、その通信はNSAの収集対象になりうる。

2013年、エドワード・スノーデンがこの実態を暴露した。国家情報長官のジェームズ・クラッパーは議会で「アメリカ人のデータを大量収集していない」と証言していたが、それは虚偽だった。スノーデンの告発はその欺瞞を白日の下にさらした。

さらに「第三者原則(サード・パーティ・ドクトリン)」という法理がある。憲法修正第4条はプライバシーを保護するが、「あなた自身のデータではなく、第三者が保有するデータ」には適用されないという解釈だ。iCloudに保存した写真、Gmailのメール、位置情報——これらはAppleやGoogleが「保有」しているため、政府は令状なしに請求できる場合がある。スマートフォン時代の今、私たちの生活のほぼすべてが「第三者のサーバー」に存在する。第三者原則は事実上、修正第4条を骨抜きにしているとも言える。

こうした歴史を知った上でAnthropicの主張を読むと、その懸念の深さがわかる。「合法的な用途に限る」という言葉は、表面上は問題ない。しかしNSAが「合法」の定義を何十年もかけて書き換えてきた歴史を知っていれば、その言葉を額面通りには受け取れない。Anthropicが恐れたのは、Claudeが「データブローカーから収集した膨大な個人情報を、AIが疲れることなく24時間分析し続けるシステム」の一部になることだった。

AIが変えるもの:スケールの問題

AI以前から、大量監視の問題は存在した。しかしAIはそのスケールを根本的に変える。

人間のアナリストが何千人いても分析しきれないデータを、AIは瞬時に処理できる。疲れない。休まない。感情的な判断を挟まない。これはつまり、これまで「物理的に不可能だった」規模の監視が、技術的に可能になることを意味する。

Anthropicが特に懸念したのは、データブローカーから購入した商業データをClaudeに処理させるシナリオだ。あなたのスマートフォンには、位置情報、購買履歴、閲覧履歴、交友関係を追跡する無数のアプリが入っている。それらのデータは広告目的で収集され、データブローカーに売られる。政府がそのデータを購入し、AIに分析させれば——令状も、裁判所の許可も、本人への通知も不要で——事実上すべての市民の行動パターンを把握できる。

各ステークホルダーの視点

トランプ政権にとって、この問題は単純だ。国家安全保障のために必要なツールを、民間企業が「倫理」を盾に拒否している。それは許容できない。「サプライチェーンリスク」指定は、交渉カードというより、脅しに近い。

***OpenAIとサム・アルトマン***の立場は微妙だ。「すべての合法的な用途」と言って契約を取ったが、その後発言を修正しつつある。監視の歴史を知らなかったのか、知っていて賭けに出たのか——どちらにせよ、政治的リスクを引き受けた。

Appleや大手クラウド企業は、似たような立場に立たされてきた。AppleはFBIのiPhoneバックドア要求を法廷で争った。クラウド企業はユーザーデータの政府請求に対して「プロセス」を設けている。Anthropicはその系譜の中にいる。

日本企業への影響は、見過ごせない。ソニー、トヨタ、富士通など、アメリカ政府と取引する日本企業はどう対応するか。特に日米安全保障の枠組みの中で、日本企業がアメリカのAIインフラに依存する度合いが高まるほど、この問題は他人事ではなくなる。日本政府自身も、AIを活用した行政サービスや安全保障への応用を検討しており、「どこまで許容するか」の線引きを迫られるだろう。

言論の自由の観点からは、興味深い議論がある。アメリカの市民的自由団体FIREは、「政府が企業に望まないコードを書くよう強制することは、憲法修正第1条が禁じる強制的言論(コンペルド・スピーチ)に当たる」と主張している。コードは言論か——この問いは、AIの時代に新たな重みを持つ。

民主主義と監視国家のはざまで

共和党・民主党を問わず、歴代政権が監視体制を拡大してきた。テロへの恐怖、国家安全保障の名のもとに。そのたびに「法の範囲内」と説明されてきた。しかし「法の範囲内」の意味が、一般市民の理解とかけ離れた形で解釈されてきた歴史がある。

トランプ政権の特異性は、その「不器用さ」にある。過去の政権が秘密裁判所と難解な法解釈で静かに進めてきたことを、公然と要求する。それは皮肉にも、問題を可視化させる効果がある。静かな拡大よりも、声高な要求の方が、社会的議論を喚起しやすい。

関連記事

イーロン・マスクがOpenAIとサム・オルトマンCEOを訴えた裁判が開幕。1340億ドルの損害賠償請求と、AI業界の覇権争いの行方を徹底解説します。

イーロン・マスクがOpenAIとサム・オルトマンを訴えた裁判が開廷。非営利から営利へのシフトは許されるのか。AI業界の未来を左右する法廷闘争の本質を読み解く。

Anthropicが実施したAIエージェント同士の売買実験「Project Deal」。186件の取引、4,000ドル超の価値。高性能モデルが優位な結果を出す一方、格差に気づかないユーザーの問題が浮上した。

OpenAIはカナダ銃乱射事件の容疑者アカウントを事前に把握・停止していたにもかかわらず、警察への通報を見送った。CEOサム・アルトマンが謝罪したが、問われるのは企業の「判断」の是非だ。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加