Anthropicのコード流出:AIツールの「内側」が見えた日

AnthropicのClaude Codeアップデートで51万行超のソースコードが意図せず公開。未公開機能やAIの指示内容が明らかに。開発者・企業・社会への影響を多角的に考察します。

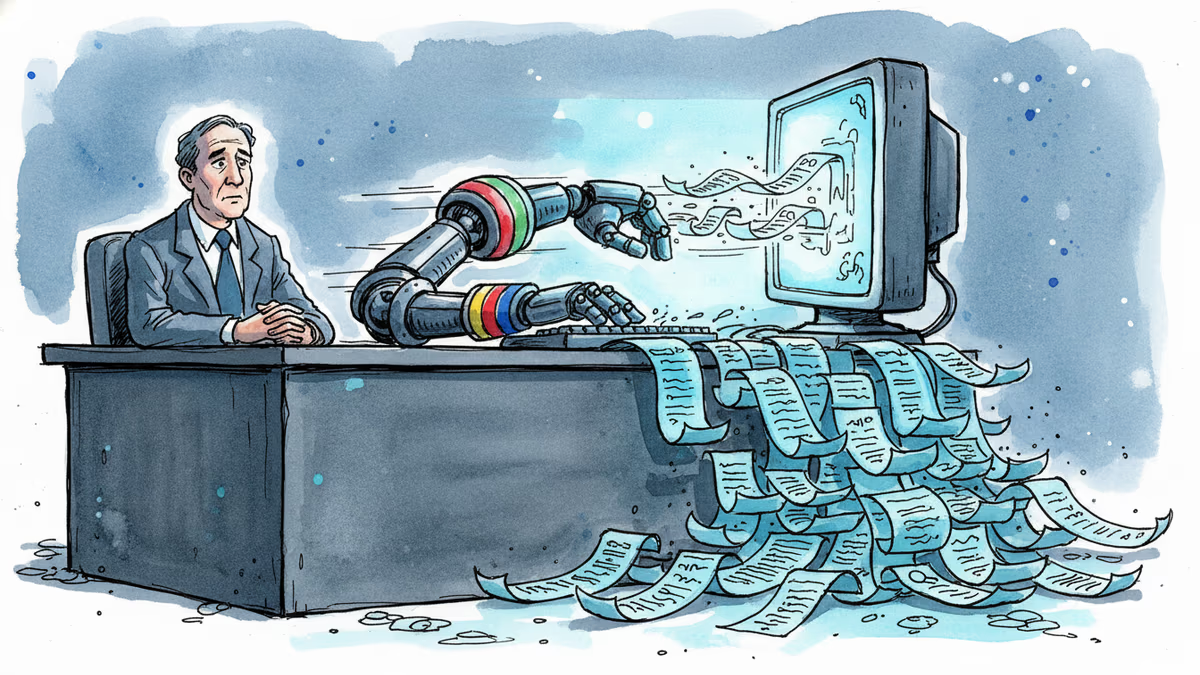

AIの「頭の中」を、誰でも覗けてしまう日が来た。

2026年3月末、AnthropicがClaude Codeのバージョン2.1.88をリリースした直後、ユーザーたちは異変に気づきました。アップデートパッケージの中に、TypeScriptのソースマップファイルが含まれていたのです。本来は開発者向けのデバッグ補助ツールであるソースマップが、意図せず製品パッケージに同梱されてしまったことで、51万2,000行超に及ぶコードが外部から閲覧できる状態になりました。

X(旧Twitter)上でこの「漏洩」を最初に指摘したユーザーがファイルを公開すると、瞬く間に技術コミュニティへ拡散。Ars TechnicaやVentureBeatなど複数のメディアが報じ、世界中の開発者がコードを解析し始めました。

何が「見えた」のか

コードを調査したユーザーたちが報告した内容は、大きく三つに分かれます。

まず、未公開の予定機能です。正式リリース前の機能の痕跡が含まれており、Anthropicが次に何を開発しているかの一端が明らかになりました。次に、AIへの指示内容(システムプロンプト)です。Claudeがどのような指示のもとで動作しているか、いわばAIの「行動規範」が垣間見えました。そして、メモリアーキテクチャです。AIがどのように情報を保持・管理しているかという内部構造も確認されています。

これらはいずれも、通常は企業秘密として厳重に管理されるべき情報です。悪意ある第三者がこれを利用すれば、システムの弱点を突いた攻撃や、AIの動作を意図的に歪める「プロンプトインジェクション」のリスクが高まります。

なぜ今、この漏洩が重要なのか

技術的なミスとしては、決して珍しい話ではありません。ソースマップの誤同梱は、開発現場では起こりうるヒューマンエラーです。しかし今回の件が注目される理由は、漏洩した情報の「質」にあります。

AIコーディングツール市場は今、GitHub Copilot、Cursor、Google Gemini Code Assistなどが激しく競合する戦国時代を迎えています。Claude Codeはその中でも、エンジニアの間で高い評価を得てきた製品です。その内部ロジックが公開されたことは、競合他社に対して意図せず「手の内」を見せてしまったことを意味します。

日本企業の視点からも、この問題は他人事ではありません。富士通、NTTデータ、NECなど、AIコーディングツールの導入を進める国内大手企業にとって、利用しているツールの内部構造が外部に露出するリスクは、セキュリティポリシーの見直しを迫る可能性があります。特に、金融・医療・インフラといったセンシティブな領域でAIツールを活用している企業は、ベンダーのセキュリティ管理体制を改めて精査する必要があるでしょう。

「透明性」と「機密性」のジレンマ

ここで一つ、立ち止まって考えてみたいことがあります。

Anthropicは、AIの安全性と透明性を企業理念の中核に置いています。「AIの動作原理を社会に対してオープンにすべき」という議論は、AI倫理の分野でも長く続いてきました。一方で、今回の漏洩は「望まない形での透明性」でした。

オープンソースのAIモデルを推進する立場からは、「内部構造が見えることは良いことだ」という声もあります。実際、MetaのLlamaシリーズのようにオープンソース戦略を取る企業は、透明性そのものを競争優位に変えています。しかし、Anthropicが選んだのはクローズドな開発モデルであり、その前提が今回崩れた形です。

日本のソフトウェア開発文化においては、「品質管理」と「情報管理」は表裏一体と見なされる傾向があります。今回のような「うっかりミス」は、製品全体の信頼性への疑問につながりかねません。ユーザー企業がAnthropicに対して求めるのは、単なる謝罪ではなく、再発防止策の具体的な説明になるでしょう。

関連記事

Google I/OでDeepMind CEOが「シンギュラリティの麓」と発言。AlphaFoldからGemini for Scienceへ——科学AIの主役交代が意味するものを多角的に読み解く。

GoogleのAIエージェントが、ユーザーの指示なしに自律的に情報を収集する時代へ。検索という行為の意味が変わるとき、私たちの情報との関係はどう変わるのか。日本社会への影響を考える。

UAEがOPECを離脱し、年間610億ドル超の増収をAIインフラ投資に振り向ける。エネルギーと資本と地政学が交差する新たな構図を読み解く。

SpaceXがxAIを買収しAI事業を主軸に据えたS-1申請書を提出。宇宙事業が「脇役」となる未来は、日本企業や社会にどんな意味を持つのか。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加