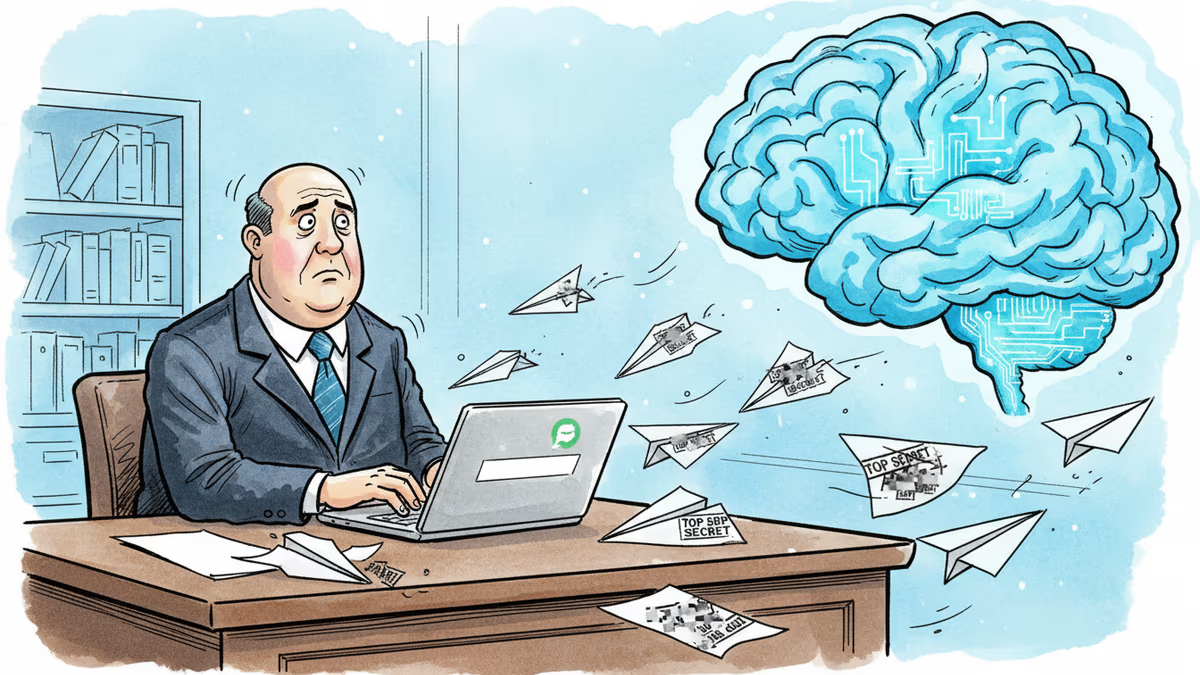

CISA幹部のChatGPT機密文書流出が問う、AIと機密情報の境界線

米国サイバーセキュリティ機関の幹部がChatGPTに機密文書をアップロード。AIの利便性と国家機密保護の狭間で揺れる組織の現実とは。

米国のサイバーセキュリティを守る最前線で、皮肉な事件が起きた。国土安全保障省傘下のサイバーセキュリティ・インフラ保護庁(CISA)のマドゥ・ゴットムッカラ代理長官が、機密文書をChatGPTにアップロードしていたことが発覚し、わずか9ヶ月で事実上の更迭となったのだ。

国家機密を守る組織のジレンマ

ABCの報道によると、2025年5月にCISAの代理長官に就任したゴットムッカラ氏は、機密文書をChatGPTにアップロードしたことが2026年1月に発覚。現在は国土安全保障省の戦略実装部門ディレクターに異動となり、サイバーセキュリティ担当のニック・アンダーセン氏が新たな代理長官に就任した。

この事件が示すのは、AIツールの利便性と機密保護の間で揺れる現実だ。ChatGPTのような生成AIは文書作成や情報整理に革命をもたらしたが、同時にデータの取り扱いについて新たなリスクを生み出している。特に政府機関では、効率化への圧力と厳格なセキュリティ要件の板挟みとなっているのが実情だ。

日本の政府機関も直面する課題

日本でも似たような課題が浮上している。デジタル庁や各省庁では業務効率化のためAIツールの導入が検討されているが、機密情報の取り扱いについては慎重な姿勢を維持している。内閣サイバーセキュリティセンター(NISC)では、生成AIの政府利用に関するガイドライン策定を進めており、米国の事例は貴重な教訓となりそうだ。

興味深いのは、この事件が「特別許可を求めた」という報道がある点だ。つまり、ゴットムッカラ氏は無断で行ったわけではなく、何らかの正当な理由があったと考えられる。しかし、サイバーセキュリティの責任者がAIツールに機密情報を預けるという行為そのものが、現在のデジタル社会の複雑さを物語っている。

効率性と安全性の新たなバランス

この事件は単なる個人の判断ミスを超えて、組織全体のAI活用方針を問い直すきっかけとなっている。政府機関では従来、「絶対に外部に出してはいけない」という二元論的なアプローチが取られてきたが、AIの時代にはより柔軟で実用的なフレームワークが必要になってきている。

日本企業でも同様の課題に直面している。トヨタやソニーといった大手企業では、社内でのChatGPT利用について独自のガイドラインを設けているが、完全な禁止ではなく「適切な利用」を模索している段階だ。

関連記事

米国防総省が確認:敵対勢力が商業的位置情報データを使い、戦場の米軍兵士を追跡・監視。広告テクノロジー産業が「国家安全保障上の脅威」として問われ始めた。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

ブラウザのサイドチャネル攻撃「FROST」が、SSDのタイミング計測により閲覧履歴やアプリ情報を盗み見る。一般ユーザーから企業まで影響する新手法を解説。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加