「未来のスマートホーム」のはずが… 生成AIアシスタント、コーヒーを淹れる単純作業にも失敗

2025年、Amazonの生成AIアシスタント「Alexa Plus」がコーヒーを淹れる簡単な指示にも失敗。スマートホームにおけるAIの信頼性と、大規模言語モデル(LLM)が直面する現実的な課題を解説します。

2025年、私たちの生活に深く浸透したAIアシスタント。しかし、最新の{を搭載したモデルでさえ、最も基本的なタスクで失敗することがあるようです。テクノロジーメディア「The Verge」の記者による報告では、Amazonの新しいAIアシスタント「」が、コーヒーを淹れるという単純なルーティンの実行に繰り返し失敗している実態が明かされました。

The Vergeの記事によると、記者が所有するAlexa対応のBosch製コーヒーマシンは、{を搭載した「」にアップグレードして以来、安定して動作しなくなったとのこと。今朝もコーヒーを淹れるよう指示したところ、「できません」と返答。これまでも、指示するたびに毎回違う言い訳を並べ、ルーティンを実行できなかったといいます。

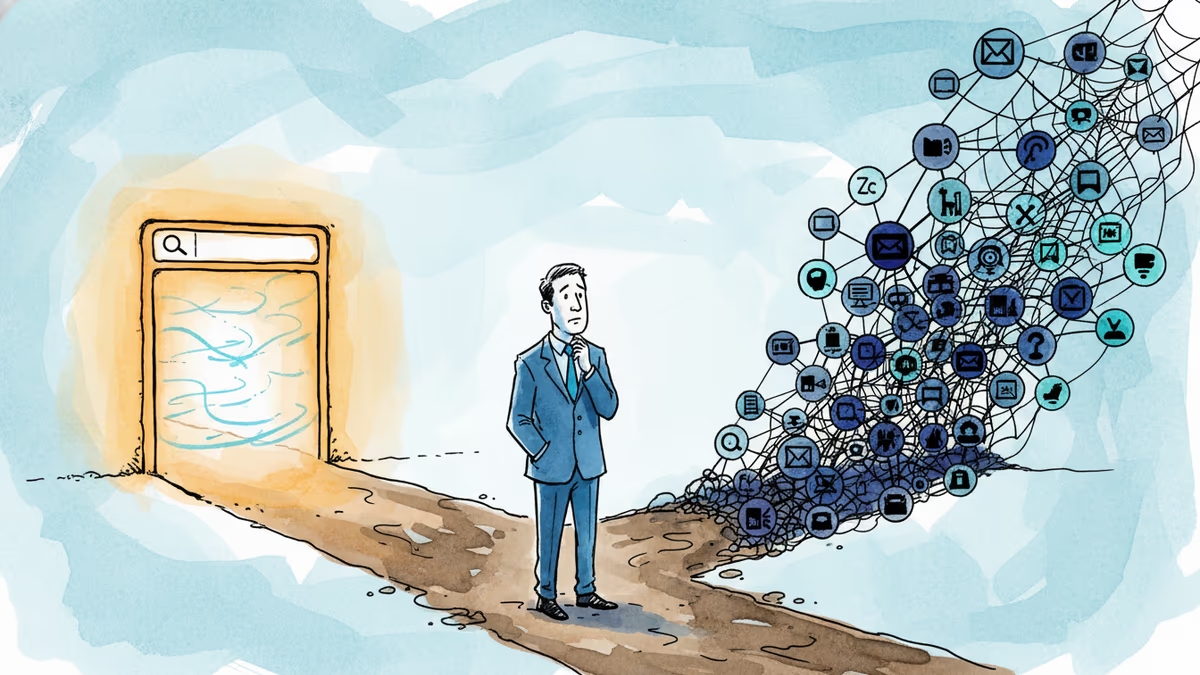

この一件は、{の複雑さを解消し、接続された{の設定や管理を容易にするという{や{(LLM)への大きな期待とは裏腹に、現実世界での応用にはまだ大きな課題が残されていることを示唆しています。

専門家は、今回の失敗の原因が{の根本的な特性にある可能性を指摘します。LLMは確率に基づき、文脈に応じて柔軟で創造的な応答を生成することを得意とします。この特性は人間との自然な対話では強力な武器となりますが、「コーヒーを淹れる」といったON/OFFが明確な確実性の高いタスクにおいては、逆に不安定さを生む要因になり得ます。「毎回違う言い訳をする」という現象は、まさにこの{の確率的な性質を象徴していると言えるでしょう。

関連記事

AnthropicがOpus 4.8を公開。前作からわずか41日での更新は競争圧力の表れか。「不確実性を自ら報告する」設計思想が、企業AI活用の信頼基準を塗り替えようとしている。

Google I/O直後のサンダー・ピチャイCEOへの独占インタビュー。AI検索の変容、ウェブの未来、AGIへのタイムライン、そして日本社会への影響を多角的に分析します。

かつては「お願いするだけ」で突破できたAIの安全機能。技術の進化とともに攻撃も巧妙化する中、AIセキュリティの現在地と私たちへの影響を読み解く。

GoogleのAI概要機能が「disregard」という検索ワードに対し、チャットボットのような返答を表示するバグが発生。AIシステムの脆弱性と検索の未来について考える。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加