核武時代的AI倫理:矽谷與五角大廈的價值觀戰爭

川普政府封殺Anthropic,核攻擊應對中的AI使用引發科技公司與軍方價值觀衝突。這場爭議揭示了AI治理的深層問題。

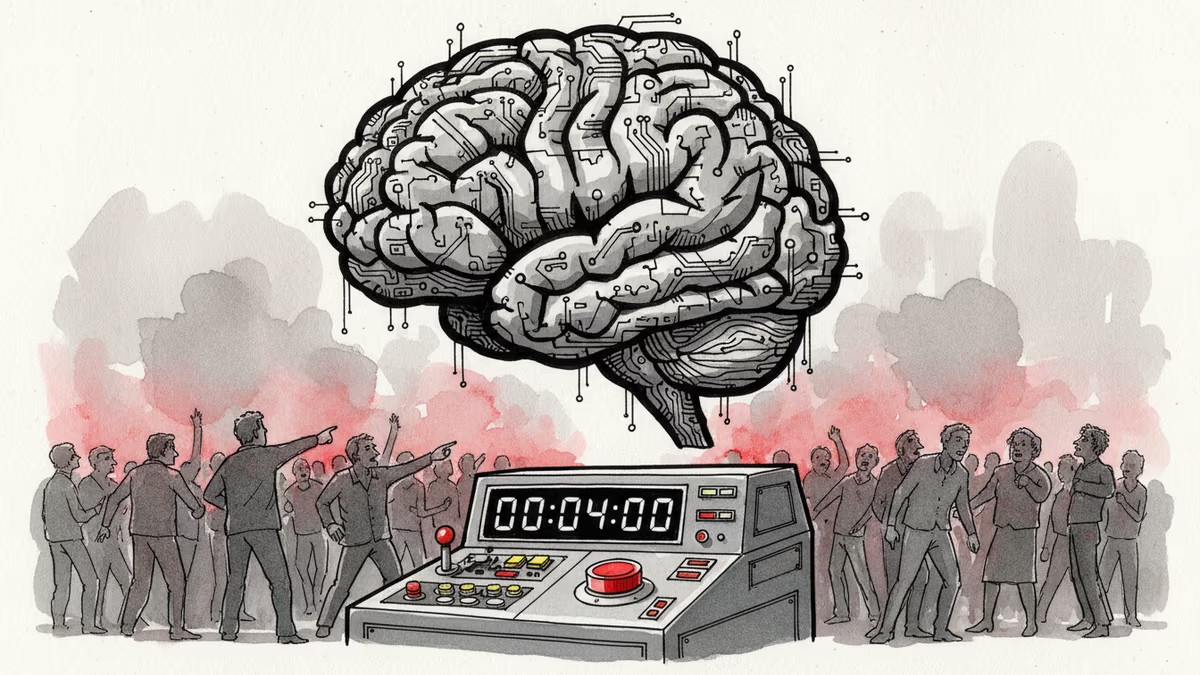

當核子飛彈朝美國飛來時,一個價值數十億美元的AI系統可能在幾分鐘內決定人類的命運。問題是:我們能信任它嗎?

川普總統週五下令整個聯邦政府停止使用AI公司Anthropic的產品,稱其為「激進左派覺醒公司」,並阻止其介入軍事決策。這場公開衝突已經成為AI未來治理之戰的縮影,而爭議的核心,竟然圍繞著一個極端假設情境:核攻擊來臨時,AI該扮演什麼角色?

生死瞬間的道德選擇

據報導,去年12月,國防部研究與工程次長埃米爾·邁克爾向Anthropic執行長達里奧·阿莫代提出了一個尖銳問題:「在核子飛彈朝美國飛來的情況下,你們公司會因為禁止將技術用於自主武器而拒絕幫助國家嗎?」

阿莫代的回應是「國防部可以聯繫我們確認」。這個謹慎的答覆激怒了邁克爾。Anthropic否認這個說法,聲稱願意為飛彈防禦創建例外條款,但無論如何,這次對話毒化了兩個機構之間的關係。

這場衝突暴露了一個更深層的問題:AI應該在多大程度上整合到核武指揮控制系統中?我們不知道目前的整合程度,但可以確定的是,美軍正積極尋求AI和機器學習的方式來「促進和加速人類決策」。

人類直覺的最後防線

關於核武器和AI的討論通常聚焦於是否應該讓機器控制核武發射能力,以及在人類最致命武器的使用討論中保持「人在迴路中」的必要性。但專家和官員表示,這個辯論只是表面問題:美國和其他國家都不太可能將核攻擊決定權交給AI。

更棘手的問題是AI在「戰略預警」功能中的依賴程度——綜合衛星、雷達和其他感測器系統收集的大量數據,盡快檢測潛在威脅。

這正是邁克爾向阿莫代提出的假設使用案例。如果系統只是用來提高攔截來襲飛彈的機會,似乎是理所當然的選擇。但在美國受到彈道飛彈攻擊的情況下,總統將立即面臨一個必須在幾分鐘內做出的決定——是否報復,這可能引發全面核戰爭。

數百萬人的生命可能依賴於系統的準確性——而核武器歷史上有許多檢測系統導致險象環生的例子,只有人類直覺才避免了災難。

華人世界的思考角度

退役中將傑克·沙納漢曾駕駛核任務飛機並擔任五角大廈聯合人工智慧中心主任,他告訴媒體,如果將核威脅檢測和應對交給AI代理,「我不想說肯定會發生災難,但我認為你正朝著那個方向前進。」

本週發表的倫敦國王學院研究發現,包括Claude、ChatGPT和Google Gemini在內的AI模型在模擬戰爭遊戲中,比人類參與者更傾向於推薦核選項。在這種情況下,AI可能不會發射武器,但總統必須在極端壓力下推翻一個聽起來驚慌失措的數十億美元系統的建議。

對於華人世界而言,這場爭議具有特殊意義。台海局勢的複雜性、東亞地區的軍事平衡,以及中美科技競爭的加劇,都讓AI軍事應用的討論更加敏感。台積電、聯發科等台灣半導體企業,以及香港、新加坡的科技公司,都可能面臨類似的倫理選擇:技術創新與國家安全需求之間如何平衡?

使軍用AI與以往具有明顯國安用途的技術不同的一個因素是,在這種情況下,大部分尖端研究都是由最初著眼於商業市場的私人公司完成的,而不是響應軍方需求的公司。(後者的例子是互聯網,它從國防部和學術項目發展而來,遠早於公司找到商業用途。)

文化衝突的新戰場

這種新動態必然導致文化衝突,特別是在像Anthropic這樣的公司——儘管到目前為止樂於讓五角大廈使用其產品,但圍繞AI安全擔憂建立了公共形象——與皮特·赫格塞斯的「反覺醒」五角大廈之間。

沙納漢領導了五角大廈2018年與Google的爭議性合作項目Maven,這是之前華盛頓-矽谷文化衝突的一個例子。他說:「波音永遠不會反對建造政府要求他們建造的任何東西。這是一家國防工業基地公司。[AI]誕生在一個非常不同的世界,這群人不像洛克希德員工看待冷戰的方式。在某種程度上,這是火星對金星。」

這場衝突如何發展,以及其他公司是否願意讓他們的模型在較少質疑的情況下部署,可能在很大程度上決定AI在假設核戰爭中可能扮演的角色。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

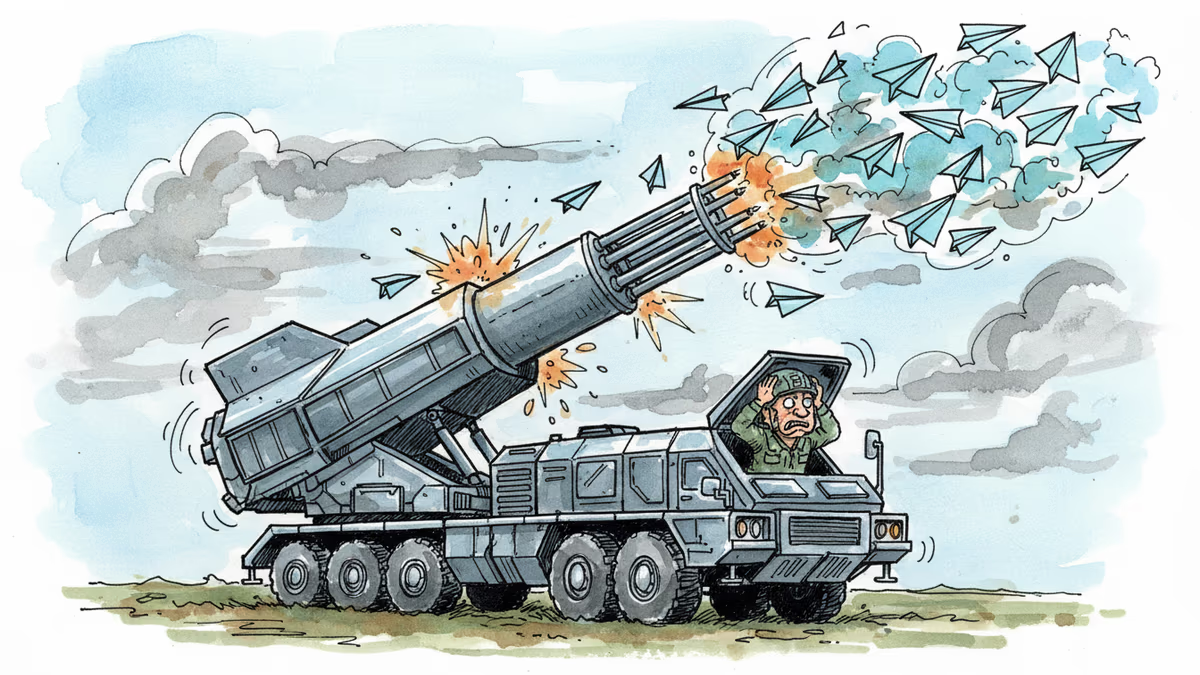

伊朗沙赫德無人機造價兩萬美元,美國戰斧飛彈要價兩百萬。當「精確的大規模攻擊」成為新常態,亞太地區的安全格局將面臨哪些根本性的挑戰?

美國每年1300萬人遭遇診斷錯誤,逾75萬人因此死亡或永久殘障。AI無法單獨解決這場危機——問題的根源,是醫療系統的價值觀本身。

美術館與拍賣行的核心是藝術專家的眼光。AI能否取代這種判斷力?從真偽鑑定到市場定價,探討人類審美與演算法之間那條看不見的界線。

Anthropic發布的AI模型Claude Mythos Preview已發現數千個重大資安漏洞,包括近30年前的系統缺陷。當私人企業擁有足以癱瘓全球基礎設施的工具,地緣政治的規則將如何改寫?

观点

分享你对这篇文章的看法

登录加入讨论