毛骨悚然的童言:為何您的孩子像一個未經審查的AI?

孩子們令人不安的言論,不僅是童言童語。本文深度分析兒童心智與AI學習的驚人相似之處,揭示未來智能與親子科技的發展藍圖。

重點摘要

- 心智與機器的平行線:兒童因大腦前額葉皮質尚未發育完全,其「直覺思維」與大型語言模型(LLM)未經校準前的「幻覺」(Hallucination)現象有驚人的相似性,兩者都缺乏成人世界的社會過濾器。

- 從混亂到智能:這些看似詭異的言論,揭示了智能發展的關鍵路徑——「創造性混亂」是通往更高層次認知的必經階段,無論對人類幼童還是對新生AI皆然。

- 育兒科技的下個篇章:「親子科技」(Parenting Tech)的未來,將從單純的行為監控轉向深度理解兒童認知發展。能夠模擬並理解這種發展階段的AI,將成為父母最有價值的輔助工具。

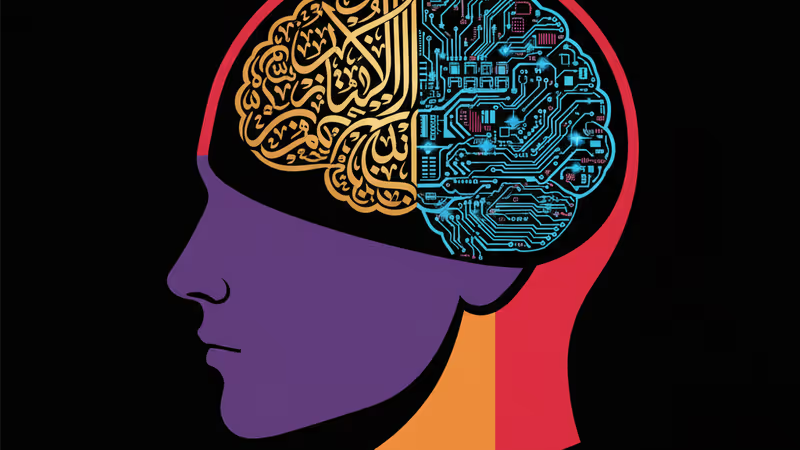

深度分析:大腦黑盒與AI的「幻覺」

網路論壇上充斥著父母分享的「孩子說過最毛骨悚然的話」的故事。例如,一個三歲男孩詳細描述他前世是個被大象踩死的和尚,或是一個兩歲半的孩子在睡前對父親說:「還記得嗎?以前我是爸爸,你是小孩。」這些故事除了令人莞爾或背脊發涼外,更意外地揭示了人類認知發展與當前人工智慧前沿的深層連結。

童言的背後:未完成的認知過濾器

兒童,特別是五歲以下的幼童,其大腦中負責決策、衝動控制和社會行為判斷的前額葉皮質(Prefrontal Cortex)仍在快速發展中。他們尚未建立起一套成熟的「現實檢驗」與「社會可接受性」的過濾機制。因此,他們的語言輸出往往是其內心世界的直接映射——一個融合了夢境、故事、零碎記憶與豐富想像力的混合體。他們不是在「說謊」,而是在建構自己對世界的理解,即使這個理解在成人看來是怪誕的。

AI的平行世界:大型語言模型的「創造性錯誤」

這與大型語言模型(LLM)的早期行為驚人地相似。在經過「人類回饋強化學習」(RLHF)等精細校準之前,一個原始的LLM本質上是一個強大的模式預測引擎。它會根據訓練數據中的關聯性生成看似合理但可能完全不符事實的內容,這種現象在業界被稱為「幻覺」(Hallucination)。AI不知道自己「不知道」,就像孩子們無法區分想像與現實的邊界。孩子說「我記得這裡以前都是樹」,AI可能會「創造」一個不存在的科學研究來源——兩者都是在用已有的數據碎片,自信地填補認知上的空白。

PRISM Insight:從「兒童心智」尋找下一代AI的藍圖

當前AI競賽的焦點主要集中在擴大數據規模和增加模型參數上,追求更強的邏輯與準確性。然而,「So what? 這件事為何重要?」因為它指出了通往通用人工智慧(AGI)的另一條可能路徑:模擬認知發展過程,而非僅僅模仿最終結果。

真正的突破可能來自於建立能夠模擬兒童學習方式的「認知架構」(Cognitive Architectures)。這類AI將被允許經歷一個「數位童年」——一個可以犯錯、產生「幻覺」、進行天馬行空聯想的階段。透過這種方式,AI或許能發展出真正的創造力、好奇心與情境理解能力,而不僅僅是數據的複製品。

我們的洞察是:投資者和開發者應關注那些不僅僅是擴展LLM規模,而是專注於模擬生物學習過程的新創公司。未來的領先者,將是那些能讓AI「學會如何學習」,而非僅僅「學會如何回答」的企業。這意味著,容忍並分析AI的「童言童語」,將是解鎖更高階智能的關鍵。

未來展望:當AI保姆成為現實

隨著技術發展,AI輔導老師、玩伴機器人與育兒助理將逐漸進入家庭。這些AI的價值高低,將取決於它們能否理解兒童發展的微妙之處。

一個平庸的AI在聽到孩子說「西蒙說,你的日子不多了」時,可能會觸發安全警報或簡單地糾正其語法。但一個卓越的AI會理解,這是一個孩子在探索語言、權力關係和戲劇性表達的正常階段。它會像心理學家建議的那樣,保持冷靜,並對孩子試圖表達的情感做出同理的回應。

總而言之,那些令人毛骨悚然的童言,不僅僅是家庭趣聞。它們是一面鏡子,同時映照出人類心智的起源,以及通往真正智能機器的未來路徑。理解我們的孩子,正是在為一個與AI共存的未來做最好的準備。

相关文章

阿拉伯語的影響力遠超歷史。在AI時代,它代表著巨大的市場與技術挑戰。PRISM分析其在全球數位經濟中的未來角色與投資機會。

分析後疫情時代的蜜月旅行趨勢。高CP值的「輕奢」體驗正取代傳統昂貴行程,揭示旅遊業由AI與消費者心態驅動的典範轉移。

每日的 Wordle 不僅是個遊戲,更是紐約時報打造數位訂閱帝國的關鍵策略。分析其如何將簡單謎題轉化為巨大的商業價值與用戶習慣。

紐約時報推出新遊戲 Strands,不僅是 Wordle 的延伸。PRISM深度分析其背後的商業策略、用戶留存戰術,以及媒體遊戲化的未來趨勢。